La plateforme vidéo de Google opère un revirement stratégique majeur en réintégrant des créateurs précédemment bannis pour désinformation. Cette décision, exclusivement appliquée sur le territoire américain, marque un tournant dans la politique de modération de YouTube face aux pressions politiques conservatrices. Les chaînes bannies pour leurs contenus complotistes autour du COVID-19 et des élections américaines retrouvent désormais leur place sur la plateforme. Cette volte-face soulève des questions cruciales sur l’équilibre entre liberté d’expression et lutte contre la désinformation dans l’écosystème numérique contemporain.

YouTube révise sa politique de modération face aux pressions conservatrices

Google a officialisé sa nouvelle stratégie dans une lettre adressée à la Chambre des représentants américains, justifiant cette orientation par un engagement renforcé envers la liberté d’expression. La plateforme reconnaît explicitement que les créateurs conservateurs possèdent « une portée étendue » et exercent un « rôle important dans le discours civique ». Cette reconnaissance marque une rupture avec les politiques de modération du contenu appliquées entre 2020 et 2022.

Les modifications touchent spécifiquement les chaînes sanctionnées pour « violations répétées des politiques d’intégrité autour du COVID-19 et des élections ». Ces contenus, auparavant considérés comme relevant du complotisme, bénéficient désormais d’une tolérance accrue. YouTube justifie cette évolution par la nécessité de « valoriser les voix conservatrices » dans l’espace numérique américain.

| Période | Politique YouTube | Chaînes concernées | Justification officielle |

|---|---|---|---|

| 2020-2022 | Bannissements massifs | Désinformation COVID-19/élections | Protection santé publique |

| 2025 | Réintégration sélective | Créateurs conservateurs | Liberté d’expression |

- Réhabilitation des chaînes bannies pour désinformation électorale

- Assouplissement des règles sur les contenus COVID-19

- Reconnaissance du poids des créateurs conservateurs

- Application limitée au territoire américain

- Maintien des restrictions européennes

Impact sur les créateurs de contenus alternatifs

Cette réorientation stratégique transforme radicalement le paysage des plateformes vidéo américaines. Les créateurs précédemment marginalisés retrouvent leur audience et leur capacité de monétisation. Certains analystes estiment que cette décision pourrait influencer d’autres réseaux sociaux dans leurs approches de la modération du contenu. L’innovation technologique dans la lutte contre la désinformation, comme celle développée par certains dispositifs multi-sensoriels sans écran, pourrait se retrouver mise de côté au profit d’une approche plus permissive.

La mesure concerne également les contenus liés à l’attaque du Capitole de janvier 2021, événement qui avait provoqué une vague de sanctions sans précédent. Les chaînes ayant appelé à l’insurrection ou minimisé la gravité de ces événements bénéficient désormais d’une seconde chance sur la plateforme. Cette évolution questionne la cohérence des politiques de sécurité numérique face aux enjeux démocratiques.

Confrontation entre YouTube et l’Union européenne sur la régulation numérique

Parallèlement à ses concessions américaines, YouTube intensifie sa critique du cadre réglementaire européen. La plateforme dénonce « une charge réglementaire disproportionnée » imposée par le Digital Services Act (DSA). Cette contestation s’inscrit dans un contexte plus large de tensions entre les géants technologiques américains et les autorités européennes de régulation.

Le DSA, entré en vigueur progressivement depuis 2022, impose aux plateformes vidéo des obligations strictes en matière de modération du contenu. YouTube affirme que ces contraintes menacent la liberté d’expression « au sein et à l’extérieur » de l’Union européenne, argument contesté par les régulateurs qui soulignent la portée géographiquement limitée de leur juridiction. Cette rhétorique fait écho aux stratégies développées dans d’autres domaines technologiques, notamment l’arrivée de l’IA Google en France.

| Région | Cadre réglementaire | Position YouTube | Sanctions potentielles |

|---|---|---|---|

| États-Unis | Autorégulation renforcée | Favorable | Minimales |

| Union européenne | DSA contraignant | Critique | Amendes substantielles |

| Royaume-Uni | Online Safety Act | Neutre | En cours d’évaluation |

- Contestation du Digital Services Act européen

- Maintien des obligations de modération en Europe

- Différenciation géographique des politiques

- Tensions diplomatiques technologiques accrues

- Risque de fragmentation des standards mondiaux

Conséquences financières et stratégiques des sanctions européennes

L’amende de 2,95 milliards d’euros infligée par la Commission européenne en septembre 2024 pour abus de position dominante continue de peser sur les relations entre Google et l’Europe. Cette sanction historique influence manifestement la stratégie de communication agressive adoptée par YouTube envers les régulateurs européens. La plateforme semble chercher à créer une pression diplomatique en alignant sa rhétorique sur celle de l’administration américaine.

Les implications dépassent le seul cadre de YouTube et touchent l’ensemble de l’écosystème numérique européen. D’autres acteurs technologiques observent attentivement cette confrontation pour ajuster leurs propres stratégies réglementaires. Le contraste avec les approches adoptées dans d’autres secteurs, comme celui du divertissement avec Apple TV renouvelant The Morning Show, illustre la spécificité des enjeux liés aux contenus générés par les utilisateurs.

Mécanismes de désinformation et stratégies d’influence sur les plateformes

Les chaînes bannies réintégrées utilisent des techniques sophistiquées pour diffuser leurs messages. L’analyse des méthodes employées révèle une professionnalisation croissante des acteurs de la désinformation. Ces créateurs exploitent les algorithmes de recommandation pour maximiser leur portée et contourner les systèmes de détection automatique.

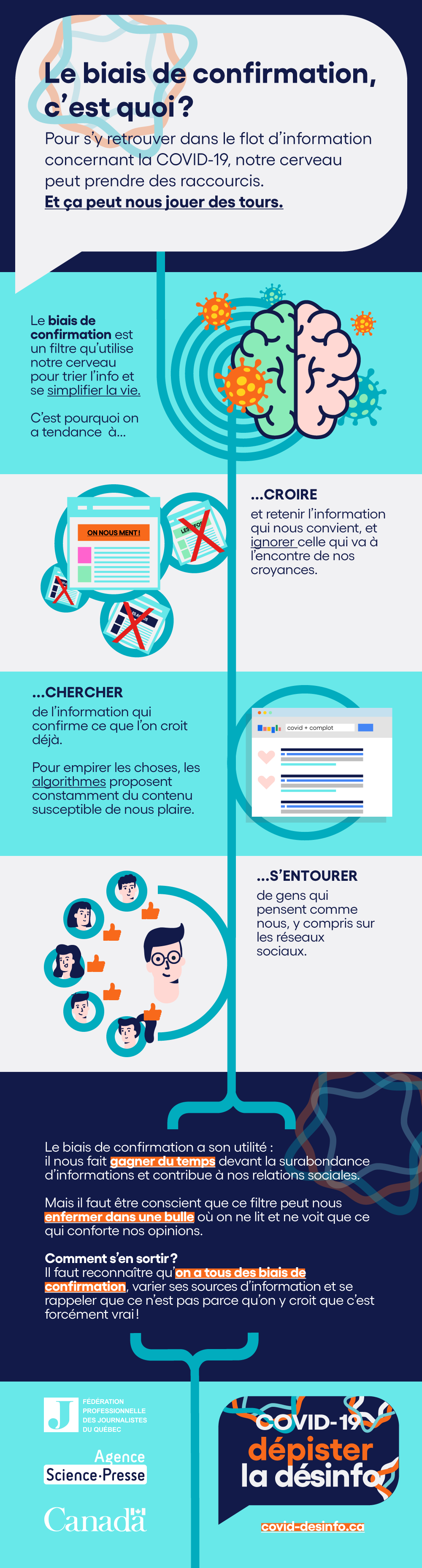

La viralité des contenus complotistes repose sur des mécanismes psychologiques précis : appel aux émotions, création de communautés fermées, validation par les pairs. Les réseaux sociaux amplifient ces phénomènes par leur architecture même, favorisant l’engagement plutôt que la véracité. Cette dynamique trouve des parallèles dans d’autres domaines, comme les questions environnementales où les enjeux de conservation du puma peuvent faire l’objet de manipulations similaires.

| Technique | Mécanisme | Impact algorithmique | Contre-mesure traditionnelle |

|---|---|---|---|

| Storytelling émotionnel | Activation limbique | Engagement élevé | Fact-checking |

| Echo chambers | Confirmation bias | Rétention audience | Diversité sources |

| Pseudo-expertise | Autorité perçue | Crédibilité artificielle | Vérification credentials |

- Exploitation des biais cognitifs humains

- Optimisation pour l’engagement algorithmique

- Construction de narratifs alternatifs cohérents

- Utilisation de témoignages personnels

- Détournement de symboles d’autorité

Évolution des techniques de manipulation numérique

Les créateurs de contenus complotistes adaptent constamment leurs stratégies aux évolutions technologiques. L’intelligence artificielle générative permet désormais de produire des « preuves » visuelles et sonores d’une qualité troublante. Ces outils démocratisent la création de deepfakes et de contenus synthétiques, compliquant drastiquement la tâche des modérateurs.

L’internationalisation des réseaux de désinformation constitue un autre défi majeur. Les créateurs exploitent les différences réglementaires entre pays pour maintenir leurs activités. Ils utilisent des VPN, des serveurs distribués et des stratégies de migration rapide entre plateformes. Cette sophistication technique contraste avec la simplicité apparente de contenus parfois produits depuis des contextes inattendus, comme les activités volcaniques aux Pays-Bas qui peuvent servir de métaphores dans des théories alternatives.

Implications pour l’écosystème de l’information et la démocratie numérique

La réintégration de contenus précédemment bannis transforme l’équilibre informationnel sur YouTube. Les algorithmes de recommandation, optimisés pour l’engagement, risquent d’amplifier des contenus controversés au détriment d’informations factuelles moins « accrocheuses ». Cette dynamique questionne le rôle des plateformes vidéo dans la formation de l’opinion publique.

L’effet de légitimation produit par cette réhabilitation dépasse le cadre de YouTube. D’autres réseaux sociaux observent attentivement cette évolution pour ajuster leurs propres politiques. La censure en ligne devient ainsi un enjeu géopolitique majeur, où les décisions techniques reflètent des choix politiques fondamentaux. Cette problématique s’étend à d’autres secteurs, notamment celui des médias traditionnels avec des productions comme The Morning Show saison 4 qui abordent ces questions d’information et de manipulation.

| Acteur | Position avant | Position après | Impact démocratique |

|---|---|---|---|

| Créateurs conservateurs | Marginalisés | Réhabilités | Polarisation accrue |

| Fact-checkers | Influence forte | Autorité questionnée | Confusion informationnelle |

| Médias traditionnels | Référence | Concurrence directe | Fragmentation audience |

- Remise en cause du consensus scientifique établi

- Polarisation accrue des débats publics

- Affaiblissement des institutions expertes

- Multiplication des sources d’information alternatives

- Complexification du paysage médiatique

Stratégies d’adaptation des acteurs traditionnels de l’information

Face à cette évolution, les médias conventionnels développent de nouvelles approches pour maintenir leur crédibilité. Certains investissent massivement dans des formats vidéo adaptés aux codes de YouTube, tandis que d’autres privilégient la différenciation par la qualité journalistique. Cette adaptation concerne aussi des secteurs connexes, comme l’industrie automobile avec Tesla Cybertruck faisant son entrée en Corée, où l’information technique doit rivaliser avec des contenus plus sensationnels.

Les institutions éducatives et scientifiques repensent également leurs stratégies de communication. Elles reconnaissent la nécessité d’adopter les codes des plateformes vidéo pour toucher leurs publics cibles. Cette évolution soulève des questions sur l’authenticité et la rigueur scientifique dans un environnement privilégiant le spectacle et l’émotion. Des domaines spécialisés, comme l’anatomie et les fonctions de santé, doivent particulièrement adapter leurs approches pour contrer la désinformation médicale.

Perspectives d’évolution et enjeux futurs de la modération numérique

L’avenir de la modération du contenu semble s’orienter vers une fragmentation géographique croissante. Les plateformes développent des systèmes différenciés selon les juridictions, créant de facto des internets régionaux avec des règles distinctes. Cette balkanisation numérique complique la circulation de l’information et peut favoriser l’émergence de bulles informationnelles nationales.

L’intelligence artificielle joue un rôle ambivalent dans cette évolution. Si elle permet d’automatiser la détection de certains contenus problématiques, elle facilite également la création de désinformation sophistiquée. Les plateformes investissent massivement dans des technologies de détection, mais les créateurs de contenus développent parallèlement des techniques d’évitement de plus en plus raffinées. Cette course technologique rappelle les défis rencontrés dans d’autres domaines, comme la protection de la faune avec la sécurité de 70 chiots retrouvés vivants, où l’innovation doit servir la protection plutôt que l’exploitation.

| Horizon temporel | Évolution probable | Défis technologiques | Impact sociétal |

|---|---|---|---|

| 2025-2027 | Fragmentation géographique | Géolocalisation contenu | Inégalités informationnelles |

| 2027-2030 | IA généralisée | Détection deepfakes | Crise de confiance |

| 2030+ | Nouveaux équilibres | Authentification universelle | Redéfinition vérité |

- Développement de standards internationaux de modération

- Émergence de plateformes spécialisées par idéologie

- Renforcement des outils de vérification citoyenne

- Évolution des compétences numériques requises

- Transformation des métiers de l’information

Rôle des utilisateurs dans la régulation collaborative

L’évolution vers des modèles de modération collaborative implique davantage les utilisateurs dans les processus de signalement et de vérification. Cette approche démocratique présente l’avantage de la scalabilité mais soulève des questions sur la qualification des modérateurs citoyens. Les initiatives de crowd-sourcing de la vérification se multiplient, créant des écosystèmes complexes où expertise professionnelle et intelligence collective se côtoient.

La gamification des processus de fact-checking attire de nouveaux participants mais peut également introduire des biais ludiques dans l’évaluation de l’information. Ces mécanismes trouvent des applications dans des domaines variés, des questions techniques comme l’optimisation SEO aux enjeux de société plus larges. L’équilibre entre accessibilité et rigueur reste un défi majeur pour ces nouvelles formes de régulation participative.

Questions fréquemment posées

Pourquoi YouTube réintègre-t-elle des chaînes précédemment bannies ?

YouTube justifie cette décision par un engagement renforcé envers la liberté d’expression et la reconnaissance du rôle important des créateurs conservateurs dans le discours civique américain. Cette évolution s’inscrit dans un contexte politique particulier aux États-Unis.

Cette politique s’applique-t-elle dans le monde entier ?

Non, ces changements concernent exclusivement le territoire américain. En Europe, YouTube reste soumise au Digital Services Act et maintient ses obligations de modération plus strictes.

Quels types de contenus sont concernés par cette réhabilitation ?

Principalement les chaînes sanctionnées pour désinformation liée au COVID-19 et aux élections américaines, ainsi que celles ayant diffusé des contenus relatifs aux événements du Capitole de janvier 2021.

Comment cette évolution affecte-t-elle la lutte contre la désinformation ?

Elle complexifie l’écosystème informationnel en réintégrant des voix précédemment marginalisées, ce qui peut contribuer à la polarisation des débats tout en enrichissant la diversité des opinions exprimées sur la plateforme.

Quelles sont les conséquences pour les autres réseaux sociaux ?

Cette décision de YouTube pourrait influencer les politiques de modération d’autres plateformes, particulièrement aux États-Unis, créant potentiellement une harmonisation vers plus de permissivité concernant certains contenus controversés.