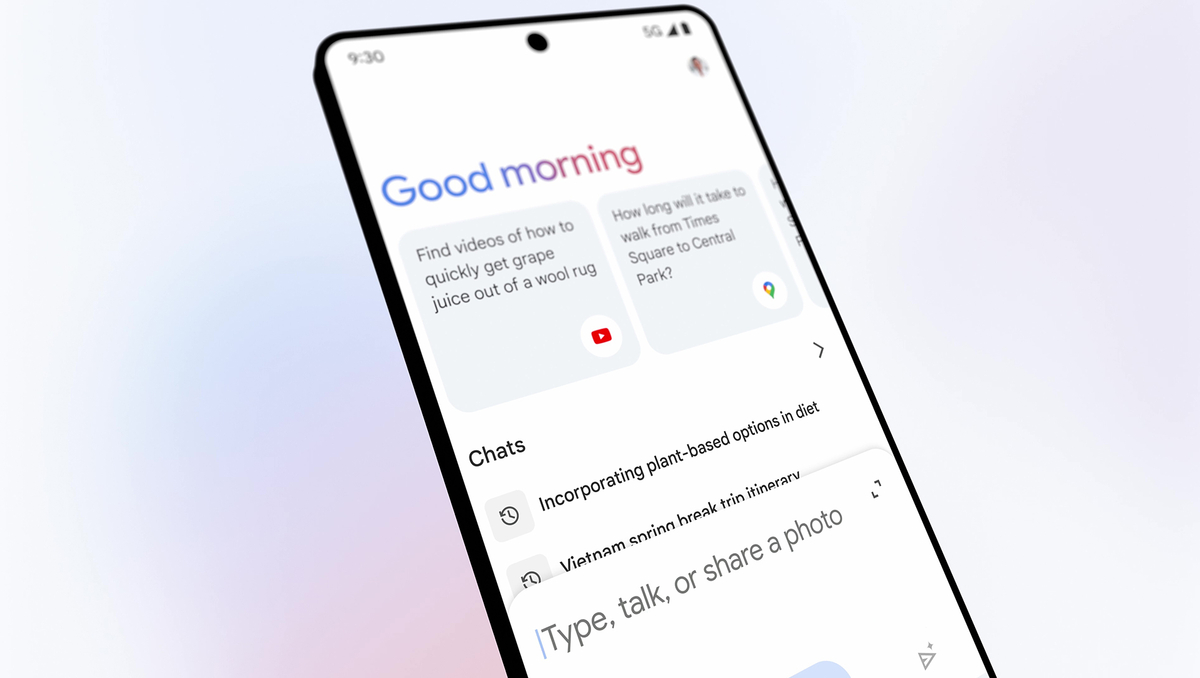

Après le triomphe de Nano Banana, Google Gemini prépare une nouvelle révolution sur Android

Nano Banana et Google Gemini : l’alliance qui redéfinit la création visuelle sur Android

Le géant de Mountain View a frappé fort en lançant Nano Banana, son outil de génération d’images qui a propulsé Google Gemini sous les projecteurs du grand public. Cette technologie a démontré une capacité impressionnante à produire des visuels de haute qualité tout en permettant leur modification instantanée, établissant un nouveau standard dans le domaine de l’intelligence artificielle mobile.

L’impact de Nano Banana sur l’écosystème Android dépasse largement les simples fonctionnalités créatives. En intégrant cette technologie directement dans son assistant conversationnel, Google a créé une synergie unique qui transforme chaque smartphone en studio de création portable. Les utilisateurs peuvent désormais générer des illustrations personnalisées, retoucher des photos existantes ou concevoir des visuels professionnels sans quitter l’interface de conversation.

Cette révolution Android s’appuie sur le modèle Gemini 3 Pro, qui intègre des capacités multimodales avancées. Le système comprend non seulement les requêtes textuelles, mais analyse également le contexte visuel pour proposer des modifications pertinentes. Par exemple, lors d’une demande de modification d’arrière-plan, l’IA identifie automatiquement les éléments à préserver et ceux à transformer, garantissant un résultat cohérent.

L’architecture technique derrière la puissance de Nano Banana

La performance de Nano Banana repose sur une infrastructure technique sophistiquée qui combine traitement local et cloud computing. Le modèle exploite les capacités de traitement neuronal intégrées aux processeurs récents des smartphones Android, notamment ceux équipés de Android 14 et des versions ultérieures. Cette approche hybride permet de générer des images de résolution 2K à 4K directement sur l’appareil.

L’optimisation pour les applications mobiles constitue un défi majeur relevé par les équipes d’innovation Google. Le modèle GEMPIX 2, qui alimente Nano Banana 2, compresse les algorithmes de génération pour les rendre compatibles avec les contraintes de mémoire et de batterie des appareils portables. Cette prouesse technique garantit que même les smartphones de milieu de gamme peuvent bénéficier de fonctionnalités avancées.

| Fonctionnalité | Nano Banana | Nano Banana Pro | Nano Banana 2 |

|---|---|---|---|

| Résolution maximale | 1080p | 2K | 4K |

| Génération vidéo | Non | Limitée | 4K courte durée |

| Modification en temps réel | Oui | Oui | Oui avec prévisualisation |

| Intégration Google Lens | Non | Partielle | Complète |

| Support texte multilangue | Basique | Avancé | Expert avec 50+ langues |

Les développeurs d’applications mobiles peuvent désormais intégrer les API de Nano Banana dans leurs propres créations, ouvrant la voie à une nouvelle génération de services créatifs. Cette accessibilité transforme le système d’exploitation Android en plateforme de création universelle, où chaque application peut potentiellement bénéficier de capacités génératives avancées.

- Génération d’images à partir de descriptions textuelles en moins de 3 secondes

- Modification sélective d’éléments spécifiques dans une composition existante

- Création de variations stylistiques multiples d’un même concept

- Intégration native avec Google Photos pour l’amélioration automatique

- Support de la génération de contenus visuels adaptés aux réseaux sociaux

- Compatibilité avec les extensions Google pour une expérience enrichie

L’expansion de Nano Banana vers d’autres services Google illustre la vision d’un écosystème unifié. Son intégration progressive dans Google Lens permet aux utilisateurs de modifier instantanément ce qu’ils voient à travers leur caméra. Cette convergence entre réalité captée et création générée ouvre des perspectives fascinantes pour la réalité augmentée et les expériences immersives.

La génération musicale : prochaine frontière de l’IA conversationnelle Android

Après avoir conquis le domaine visuel, Google Gemini s’apprête à révolutionner la création sonore sur Android. Les indices découverts dans la version 17.2.51 de l’application Google révèlent l’existence d’un module baptisé « TYPE_MY_STUFF_GENERATED_MUSIC », suggérant l’arrivée imminente de fonctionnalités de composition musicale assistée par IA.

Cette évolution s’inscrit dans la continuité logique des efforts de Google pour transformer son assistant conversationnel en studio de création multimédia complet. Alors que le modèle Lyria, déjà intégré à Veo pour la génération vidéo, démontre les capacités de l’entreprise en matière de synthèse sonore, son déploiement au sein de Gemini marquerait une étape décisive vers l’accessibilité universelle de la création musicale.

Le Pixel 10 offre actuellement un aperçu de ces possibilités à travers son application Enregistreur, qui permet de générer des pistes musicales à partir de simples descriptions textuelles. Cette fonctionnalité, bien que limitée à un appareil spécifique, préfigure l’intégration plus large prévue pour l’ensemble de l’écosystème Android. L’objectif consiste à démocratiser la composition musicale en la rendant aussi accessible que la prise de photo.

Lyria et Veo : les fondations technologiques de la création sonore

Le modèle Lyria représente une avancée significative dans la génération de musique par intelligence artificielle. Contrairement aux systèmes précédents qui assemblaient des échantillons préenregistrés, Lyria synthétise directement les formes d’onde audio en comprenant les structures harmoniques, mélodiques et rythmiques. Cette approche permet de créer des compositions originales qui respectent les conventions musicales tout en offrant une variété créative inédite.

L’intégration avec Veo, l’outil de génération vidéo de Google, démontre la capacité du système à synchroniser audio et visuel. Cette synergie devient particulièrement pertinente pour les créateurs de contenu qui souhaitent produire des vidéos accompagnées de bandes sonores personnalisées. La perspective d’accéder à ces fonctionnalités directement depuis l’interface conversationnelle de Gemini simplifie radicalement le processus créatif.

| Caractéristique | Génération actuelle | Génération prévue Gemini |

|---|---|---|

| Durée des compositions | 30 secondes | Jusqu’à 3 minutes |

| Styles musicaux supportés | 12 genres principaux | 50+ genres et fusions |

| Personnalisation instrumentale | Limitée | Contrôle granulaire |

| Export multi-formats | MP3 uniquement | MP3, WAV, FLAC, MIDI |

| Intégration apps tierces | Aucune | API ouverte |

Les captures d’écran révélées par Android Authority montrent une interface épurée où l’utilisateur peut décrire l’ambiance souhaitée, préciser les instruments ou même référencer des styles musicaux existants. Le système génère alors plusieurs variations, permettant de sélectionner celle qui correspond le mieux à la vision initiale. Cette approche itérative transforme la création musicale en dialogue créatif entre l’utilisateur et l’IA.

- Génération de mélodies originales à partir de descriptions d’ambiance

- Adaptation automatique du tempo et de la tonalité selon le contexte

- Création de boucles rythmiques pour accompagner des vidéos

- Synthèse de jingles personnalisés pour contenus de marque

- Composition de bandes sonores atmosphériques pour méditations ou podcasts

L’impact potentiel sur l’industrie créative reste considérable. Les créateurs de contenu pour plateformes comme YouTube, TikTok ou Instagram pourraient accéder à des bibliothèques musicales illimitées sans contraintes de droits d’auteur. Cette démocratisation soulève néanmoins des questions sur l’avenir des musiciens professionnels et la définition même de la créativité artistique à l’ère de l’intelligence artificielle générative.

L’écosystème Gemini : une intégration progressive dans tous les services Google

La stratégie de Google transcende le simple développement d’outils isolés pour embrasser une vision d’intégration systémique. Nano Banana et les futures capacités musicales ne constituent que les manifestations visibles d’une transformation profonde qui touche l’ensemble des services de l’entreprise. Cette approche holistique vise à faire de Gemini la colonne vertébrale de l’innovation Google pour la prochaine décennie.

L’extension de Nano Banana à Google Lens illustre parfaitement cette philosophie d’intégration. Les utilisateurs peuvent désormais pointer leur caméra vers n’importe quel objet et demander à l’IA de le placer dans un contexte différent, de modifier ses couleurs ou même de générer des variantes stylistiques. Cette fusion entre perception visuelle et création générative redéfinit les frontières entre photographie et illustration numérique.

NotebookLM bénéficie également de cette expansion, permettant aux étudiants et professionnels de générer des diagrammes, schémas ou illustrations pour accompagner leurs notes. Cette fonctionnalité transforme la prise de notes traditionnelle en expérience multimédia enrichie, où chaque concept peut être visualisé instantanément. L’impact sur l’apprentissage et la mémorisation pourrait se révéler significatif, en capitalisant sur les capacités de traitement visuel du cerveau humain.

Google Photos et l’édition intelligente : quand l’IA devient photographe

L’arrivée prévue de Nano Banana dans Google Photos marque une évolution majeure pour cette application utilisée par plus d’un milliard de personnes. Au-delà de la simple retouche, le système proposera des améliorations contextuelles basées sur l’analyse sémantique des images. Par exemple, lors d’une photo de groupe où une personne a les yeux fermés, l’IA pourra générer une version corrigée en se basant sur d’autres photos de la même personne.

Cette capacité d’édition intelligente s’étend à la reconstruction de souvenirs incomplets. Si une photo de vacances manque d’un élément mémorable présent dans le lieu visité, l’utilisateur pourra demander son ajout en décrivant simplement ce qu’il souhaite voir apparaître. Cette approche soulève des questions philosophiques fascinantes sur l’authenticité des souvenirs et la frontière entre documentation et recréation.

| Service Google | Intégration Nano Banana | Cas d’usage principal | Disponibilité |

|---|---|---|---|

| Gemini | Complète | Création conversationnelle | Déployé |

| Google Lens | Progressive | Modification réalité augmentée | Bêta |

| NotebookLM | Partielle | Visualisation concepts | Bêta |

| Google Photos | En développement | Édition intelligente | Prévu 2025 |

| Google Workspace | En test | Illustrations présentations | Accès anticipé |

L’intégration dans Google Workspace transforme la création de présentations professionnelles. Les utilisateurs de Slides peuvent générer des graphiques personnalisés, des illustrations de concepts abstraits ou des visuels de marque cohérents sans recourir à des banques d’images génériques. Cette fonctionnalité répond à un besoin crucial des professionnels qui manquent souvent de ressources créatives pour accompagner leurs idées.

- Génération automatique d’illustrations pour documents Google Docs

- Création de maquettes visuelles dans Google Sheets basées sur des données

- Production d’avatars professionnels personnalisés pour Google Meet

- Conception de bannières et visuels pour Google Sites

- Élaboration de storyboards visuels dans Google Keep

Cette stratégie d’intégration omniprésente positionne Google comme acteur dominant face à ses concurrents dans la course à l’intelligence artificielle générative. Alors qu’OpenAI se concentre principalement sur ChatGPT et Anthropic sur Claude, Google déploie ses capacités IA à travers un écosystème de services interconnectés, créant un effet de réseau difficile à reproduire pour des entreprises moins diversifiées.

Gemini 3 et Nano Banana Pro : le duo technologique qui bouscule la concurrence

Le lancement simultané de Gemini 3 Pro et de Nano Banana Pro témoigne de la maturité technologique atteinte par Google dans le domaine de l’intelligence artificielle multimodale. Ces modèles représentent une évolution substantielle par rapport à leurs prédécesseurs, avec des améliorations mesurables en termes de précision, de vitesse et de compréhension contextuelle.

Gemini 3 Pro se distingue par ses capacités de raisonnement avancées, permettant de maintenir des conversations complexes tout en gérant simultanément des tâches de génération créative. Cette architecture permet par exemple de discuter des modifications souhaitées pour une image tout en générant des variations en arrière-plan, créant une expérience fluide qui masque la complexité technique sous-jacente.

Nano Banana Pro introduit des améliorations significatives en matière de réalisme visuel et de gestion du texte dans les images. L’un des défis majeurs des générateurs d’images IA concerne la cohérence typographique, souvent source d’artefacts visuels. La nouvelle version intègre un module spécialisé qui traite le texte comme un élément graphique distinct, garantissant lisibilité et cohérence stylistique.

Performances comparatives et positionnement stratégique

Les benchmarks indépendants placent Gemini 3 Pro parmi les modèles les plus performants du marché, rivalisant directement avec GPT-4 Turbo d’OpenAI et Claude 3 d’Anthropic. Cette parité technique s’accompagne d’avantages compétitifs liés à l’intégration native avec l’écosystème Android, offrant des capacités de traitement local impossibles pour des concurrents dépendants exclusivement du cloud.

La stratégie de Google repose sur une différenciation par l’accessibilité et l’intégration plutôt que par la performance brute uniquement. En rendant Gemini disponible gratuitement avec des limitations raisonnables, puis en proposant des formules premium pour les usages intensifs, l’entreprise reproduit le modèle économique qui a fait le succès de Gmail et Google Drive. Cette approche favorise l’adoption massive, créant un effet de réseau qui renforce la position dominante.

| Critère | Gemini 3 Pro | GPT-4 Turbo | Claude 3 Opus |

|---|---|---|---|

| Vitesse de génération d’image | 2,3 secondes | N/A | N/A |

| Longueur contexte max | 1M tokens | 128K tokens | 200K tokens |

| Précision texte dans images | 94% | N/A | N/A |

| Coût API (par 1M tokens) | 7$ | 10$ | 15$ |

| Disponibilité mobile native | Oui | Via app tierce | Via app tierce |

L’intégration avec le système d’exploitation Android confère à Gemini des avantages uniques en termes d’accès aux données contextuelles. Le modèle peut analyser les messages récents, le calendrier ou la localisation pour affiner ses réponses et suggestions, créant une expérience personnalisée impossible pour des assistants tiers disposant d’autorisations limitées. Cette capacité à comprendre le contexte global de l’utilisateur transforme l’IA d’outil ponctuel en compagnon numérique permanent.

- Compréhension contextuelle basée sur l’historique des applications Android

- Suggestions proactives anticipant les besoins selon l’heure et la localisation

- Intégration native avec les notifications pour interactions enrichies

- Synchronisation multi-appareils via compte Google pour continuité d’expérience

- Personnalisation progressive des réponses basée sur les préférences apprises

La dimension éthique de ces capacités d’intégration profonde soulève des interrogations légitimes sur la confidentialité des données. Google insiste sur le traitement local de nombreuses opérations sensibles et sur l’anonymisation des données transmises au cloud. Néanmoins, la puissance même de ces outils repose sur l’analyse de comportements personnels, créant une tension inhérente entre performance et vie privée que l’entreprise devra continuer à gérer avec transparence.

L’expansion de Gemini vers des capacités multimodales complètes, incluant texte, image, son et bientôt vidéo, positionne Google pour dominer ce que certains analystes nomment déjà le futur numérique de l’interaction humain-machine. Cette convergence médiatique au sein d’une seule interface conversationnelle simplifie radicalement l’accès aux outils créatifs, transformant potentiellement chaque utilisateur Android en créateur multimédia capable de produire contenus visuels, sonores et audiovisuels professionnels depuis son smartphone.

Perspectives d’évolution et impacts sur l’écosystème mobile

La trajectoire de développement tracée par Google avec Gemini et Nano Banana esquisse un avenir où la distinction entre création assistée et création autonome s’estompe progressivement. Les prochaines itérations devraient intégrer des capacités de raisonnement créatif permettant à l’IA non seulement d’exécuter des instructions, mais de proposer des directions artistiques basées sur une compréhension profonde des intentions utilisateur.

L’intégration prévue avec Google Home et les appareils connectés étend le champ d’application au-delà du smartphone. Imaginez demander vocalement à votre assistant domestique de créer une ambiance musicale originale adaptée à votre humeur, ou de générer des œuvres d’art numériques pour affichage sur vos écrans connectés. Cette ubiquité transforme l’environnement domestique entier en espace créatif interactif.

Les développeurs d’applications mobiles disposent désormais d’API permettant d’intégrer ces capacités génératives dans leurs propres créations. Cette ouverture favorise l’émergence d’usages inédits, depuis les applications de design d’intérieur générant des visualisations photoréalistes jusqu’aux outils pédagogiques créant des illustrations personnalisées pour chaque concept enseigné. L’écosystème Android devient ainsi une plateforme où l’intelligence artificielle générative imprègne chaque expérience utilisateur.

Défis techniques et opportunités d’innovation

Malgré les avancées impressionnantes, plusieurs défis techniques persistent. La génération de séquences vidéo longues reste problématique, avec des incohérences temporelles apparaissant au-delà de quelques secondes. Les équipes de recherche travaillent sur des architectures de mémoire à long terme permettant au modèle de maintenir cohérence narrative et visuelle sur des durées étendues, ouvrant la voie à la création de courts-métrages entièrement générés.

La personnalisation constitue un autre axe de développement majeur. Les futures versions de Gemini devraient permettre aux utilisateurs de former des modèles personnalisés reflétant leur style créatif unique. Cette approche transformerait l’IA d’outil générique en extension personnalisée de la créativité individuelle, capable de générer du contenu dans un style reconnaissable comme signature de son utilisateur.

| Domaine d’évolution | État actuel | Objectif 2026 | Impact potentiel |

|---|---|---|---|

| Génération vidéo | 5-10 secondes max | Jusqu’à 3 minutes | Création contenu social autonome |

| Personnalisation stylistique | Limitée | Modèles utilisateur uniques | Signature créative IA personnelle |

| Compréhension multilingue | 50+ langues | 120+ langues | Démocratisation globale |

| Traitement temps réel | 2-3 secondes | Instantané (<0,5s) | Expériences interactives fluides |

| Intégration AR/VR | Expérimentale | Native et optimisée | Création spatiale immersive |

L’impact sur l’industrie créative traditionnelle suscite des débats passionnés. Certains artistes considèrent ces outils comme menace existentielle, tandis que d’autres y voient des amplificateurs de créativité démocratisant l’expression artistique. La réalité se situe probablement entre ces extrêmes, avec émergence de nouvelles formes hybrides où compétence humaine et capacité IA se complètent pour produire des œuvres impossibles par chaque entité séparément.

- Démocratisation de la création professionnelle pour créateurs occasionnels

- Réduction drastique des coûts de production de contenus visuels et sonores

- Émergence de nouveaux métiers centrés sur la direction d’IA créatives

- Transformation des workflows créatifs traditionnels dans agences et studios

- Questionnements éthiques sur l’authenticité et la propriété intellectuelle

- Opportunités éducatives pour apprentissage par création immersive

Les partenariats stratégiques annoncés avec Samsung et d’autres fabricants Android accélèrent le déploiement matériel optimisé pour ces charges de travail IA. Les prochaines générations de processeurs mobiles intégreront des unités de traitement neuronal dimensionnées spécifiquement pour exécuter efficacement les modèles Gemini, réduisant consommation énergétique et latence tout en augmentant la complexité des tâches réalisables localement.

L’éducation représente un secteur particulièrement prometteur pour ces technologies. Des initiatives comme Gemini pour l’éducation permettent déjà aux enseignants de créer des supports pédagogiques visuellement riches adaptés aux besoins spécifiques de chaque classe. Les étudiants peuvent visualiser instantanément des concepts abstraits, depuis structures moléculaires complexes jusqu’à événements historiques recréés visuellement, transformant l’apprentissage théorique en expérience multimédia immersive.

La convergence entre réalité augmentée et génération IA esquisse des possibilités fascinantes. Les futures lunettes AR pourraient afficher des éléments générés en temps réel se superposant harmonieusement au monde physique, créant des expériences mixtes où réel et virtuel s’entremêlent de manière indiscernable. Cette fusion transformerait notre perception même de l’environnement, enrichissant continuellement l’expérience quotidienne par des couches informationnelles et créatives contextuelles.

La dimension sociale de ces évolutions mérite attention particulière. L’accessibilité universelle à des outils créatifs puissants pourrait réduire les barrières économiques traditionnelles séparant amateurs et professionnels. Néanmoins, elle soulève également des questions sur la valeur économique de la créativité lorsque la production devient quasi-instantanée et illimitée. Les modèles économiques des industries créatives devront s’adapter à cette nouvelle réalité où la rareté n’est plus technique mais conceptuelle.

Nano Banana est-il disponible sur tous les smartphones Android ?

Nano Banana est actuellement disponible via l’application Google Gemini sur la plupart des smartphones Android fonctionnant sous Android 14 ou versions ultérieures. Les fonctionnalités avancées comme la génération 4K de Nano Banana 2 requièrent des processeurs récents avec unités de traitement neuronal dédiées. Les appareils plus anciens peuvent accéder aux fonctionnalités de base avec traitement cloud, bien que cela nécessite une connexion internet stable.

Comment fonctionne la génération musicale prévue dans Gemini ?

La génération musicale s’appuie sur le modèle Lyria qui comprend les structures harmoniques et rythmiques pour créer des compositions originales. Les utilisateurs pourront décrire l’ambiance souhaitée, préciser des instruments ou référencer des styles musicaux via une interface conversationnelle. Le système génère plusieurs variations permettant de sélectionner et affiner le résultat. Cette fonctionnalité devrait se déployer progressivement après son intégration dans l’application Gemini principale.

Gemini 3 Pro est-il gratuit ou payant ?

Google propose Gemini avec un modèle freemium. La version gratuite offre un accès aux fonctionnalités de base avec limitations sur le nombre de générations quotidiennes. Les abonnements Gemini Advanced et Gemini Pro débloquent capacités étendues, traitement prioritaire, résolutions supérieures et fonctionnalités exclusives comme la génération vidéo longue durée. Les tarifs varient selon les régions et offres promotionnelles en cours.

Quelles différences entre Nano Banana et les générateurs d’images concurrents ?

Nano Banana se distingue par son intégration native dans l’écosystème Android et Google, permettant un accès direct depuis multiples services sans changement d’application. Sa capacité de modification contextuelle en temps réel et son optimisation pour traitement mobile le différencient des solutions principalement cloud. La précision dans le rendu de texte et la cohérence stylistique constituent également des points forts reconnus par les utilisateurs et tests indépendants.

Les créations générées par Gemini sont-elles protégées par des droits d’auteur ?

La question des droits d’auteur sur contenus générés par IA reste juridiquement complexe et varie selon les juridictions. Google accorde généralement aux utilisateurs une licence d’exploitation commerciale sur leurs créations Gemini, tout en conservant certains droits d’utilisation des données pour améliorer ses modèles. Il est recommandé de consulter les conditions d’utilisation spécifiques et, pour usages commerciaux importants, de vérifier la législation applicable dans votre région concernant la propriété intellectuelle des œuvres assistées par IA.

Article précédent

Chien dangereux : peine de prison pour le propriétaire après la mort d’un homme à Pinoso pour défaut d’indemnisation

Article suivant

Découvrez les dernières nouveautés des spectacles à bord du Norwegian Escape et du Norwegian Getaway

nadia

Bonjour, je m'appelle Nadia et j'ai 36 ans. Je suis une journaliste passionnée par la technologie. Bienvenue sur mon site web où je partage mes articles et mes découvertes dans le monde de la tech.

Tous ses articlesSur le même sujet

#android« Tap to Share » : Android s’inspire du NameDrop d’Apple pour un partage simplifié

Google s’apprête à transformer radicalement la façon dont les utilisateurs Android partagent leurs contenus. Baptisée...

Google affirme que la navigation sur Android surpasse celle de l’iPhone en vitesse

Les benchmarks qui bouleversent l’écosystème mobile Google frappe un grand coup dans l’univers de la technologie mobi...

Après 18 ans sur le marché, Android dévoile enfin la raison derrière la stratégie gagnante d’Apple

Dix-huit années après avoir bouleversé l’industrie mobile, Android occupe une position dominante sur le marché mondia...

Articles similaires

Pourquoi la mémorisation reste incontournable à l’ère de l’intelligence artificielle

Pourquoi la mémorisation demeure essentielle dans l’ère de l’intelligence artificielle et de l’apprentissage À l’heur...

Google Chrome déploie l’écran partagé pour son mode IA, mais cette innovation reste inaccessible en France

Le navigateur le plus utilisé au monde franchit une nouvelle étape dans l’intégration de l’intelligence artificielle ...

GTA 6 : Le créateur du jeu partage son point de vue éclairé sur l’intelligence artificielle

français GTA 6 et l’intelligence artificielle: une révolution à l’horizon du jeu vidéo À l’approche de la sortie…

Commentaires 0

Populaires · Récents