Producer.AI : la nouvelle aventure de Google avec Lyria 3, un défi toujours aussi intrigant

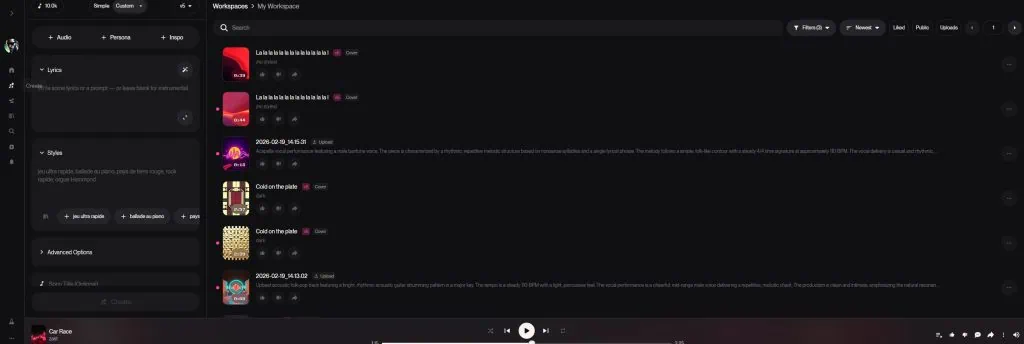

Google franchit une nouvelle étape dans le domaine de la génération musicale par intelligence artificielle en intégrant Producer.AI à ses Google Labs. Cette plateforme de création sonore, soutenue initialement par le duo électro The Chainsmokers, s’appuie désormais sur Lyria 3, le modèle musical de pointe développé par Google DeepMind. L’annonce marque un tournant dans l’approche de la création musicale assistée par machine learning, promettant de transformer radicalement la manière dont les sons, les mélodies et les arrangements sont conçus. Avec cette acquisition, Google consolide son écosystème d’outils génératifs qui comprend déjà Nano Banana pour les images et Veo pour la vidéo. La technologie permet de générer des chansons complètes, des clips vidéo musicaux et des paroles à partir de simples requêtes en langage naturel. Les utilisateurs peuvent écrire des demandes telles que « crée un beat lofi » et obtenir instantanément une composition audio de qualité professionnelle. Cette démocratisation de la production musicale soulève autant d’enthousiasme que d’interrogations quant à l’avenir de la créativité humaine dans l’industrie musicale.

Producer.AI et Lyria 3 : quand l’intelligence artificielle rencontre la production musicale

La plateforme Producer.AI représente l’évolution directe de Riffusion, un projet lancé en juillet 2025 qui explorait déjà les capacités de génération sonore par intelligence artificielle. Avec son intégration aux Google Labs, l’outil bénéficie désormais de la puissance de calcul et de l’expertise technique de Google DeepMind pour proposer Lyria 3, un modèle musical capable de comprendre les subtilités de la composition, du rythme à l’arrangement.

Ce modèle musical se distingue par sa capacité à générer de l’audio haute fidélité de qualité professionnelle. Contrairement aux premières générations d’outils d’IA musicale qui produisaient des résultats souvent artificiels et répétitifs, Lyria 3 intègre une compréhension approfondie de la musicalité. Le système analyse les structures harmoniques, les progressions d’accords, les motifs rythmiques et même les nuances émotionnelles d’un morceau pour créer des compositions cohérentes et expressives.

Les capacités techniques de Lyria 3 incluent des contrôles granulaires sur des paramètres essentiels comme le tempo, la tonalité, l’instrumentation et l’alignement temporel des paroles. Cette précision permet aux utilisateurs d’affiner leurs créations bien au-delà d’une simple génération aléatoire. Par exemple, un producteur peut spécifier exactement à quel moment les paroles doivent s’aligner avec les temps forts de la batterie, ou ajuster progressivement le tempo pour créer des transitions fluides entre différentes sections d’un morceau.

L’architecture technique repose sur des réseaux de neurones entraînés sur des millions de compositions musicales, couvrant une vaste gamme de genres, d’époques et de styles. Cette diversité d’entraînement confère à Lyria 3 une polyvalence remarquable, capable de générer aussi bien du jazz sophistiqué que de l’électro minimaliste, du rock énergique que de la musique classique contemporaine. Le modèle a également été optimisé pour comprendre les références culturelles et les conventions stylistiques propres à chaque genre musical.

Un aspect particulièrement innovant réside dans la capacité de Lyria 3 à transformer non seulement du texte, mais aussi des images en audio. Cette multimodalité ouvre des perspectives créatives fascinantes : imaginer une atmosphère sonore à partir d’une photographie de paysage, ou générer une bande-son évoquant les émotions d’un tableau. Cette fonctionnalité témoigne de l’ambition de Google de créer des passerelles fluides entre différents médias créatifs, unifiant texte, image, son et vidéo dans un écosystème cohérent.

Une technologie conçue pour les non-musiciens ou un outil pour professionnels ?

Le positionnement de Producer.AI révèle une ambiguïté stratégique intéressante. D’un côté, la plateforme se présente comme accessible aux novices grâce à son interface en langage naturel. N’importe qui peut théoriquement créer de la musique sans connaissances en théorie musicale, en production audio ou en maîtrise d’instruments. Cette démocratisation radicale s’inscrit dans la vision de Google de rendre la création accessible au plus grand nombre, prolongeant la philosophie des outils grand public comme Google Docs ou Photos.

Pourtant, Google multiplie les témoignages d’artistes établis pour crédibiliser l’outil. Élie Roman, directeur produit chez Google Labs et fondateur de Songza (rachetée par Google en 2014), raconte avoir composé des bandes-son personnalisées pour ses séances de sport et des chansons d’anniversaire pour ses proches. Cette anecdote illustre une utilisation domestique, presque ludique, de la technologie. Dans une vidéo YouTube promotionnelle, Wyclef Jean affirme avoir utilisé Lyria pour créer son dernier morceau, conférant à l’outil une légitimité artistique auprès du grand public.

Alex Pall des Chainsmokers exprime un enthousiasme particulièrement appuyé pour la plateforme : « Nous sommes extrêmement reconnaissants de voir comment cette plateforme continue d’évoluer. Elle est véritablement conçue autour de l’expérience du musicien. Les fondateurs sont incroyablement compétents techniquement, mais aussi musiciens de formation, et ils comprennent les subtilités qui font d’une plateforme un véritable outil enrichissant dans le processus de création. »

Cette mise en avant d’artistes reconnus pour promouvoir un outil pensé principalement pour les non-musiciens crée un certain malaise. Les Chainsmokers n’ont manifestement pas utilisé Producer.AI pour produire leur prochain album. La plateforme leur sert davantage de terrain d’exploration créative, de sandbox expérimentale, que de workflow de production professionnel. Cette distinction compte énormément, surtout lorsque Google évoque dans le même paragraphe sa volonté de « valoriser le talent artistique humain ».

La question se pose alors : qui est réellement la cible de Producer.AI ? Les amateurs qui souhaitent créer des jingles pour leurs vidéos YouTube ? Les créateurs de contenu qui ont besoin de musiques libres de droits ? Les musiciens professionnels en quête de nouveaux outils d’inspiration ? Ou peut-être les trois à la fois ? Cette pluralité de publics potentiels révèle l’ampleur du défi auquel Google fait face : créer un outil suffisamment simple pour être accessible, mais suffisamment sophistiqué pour rester pertinent aux yeux des professionnels.

Spaces : la fonctionnalité qui pourrait tout changer dans la création musicale

Parmi l’ensemble des fonctionnalités proposées par Producer.AI, Spaces se distingue comme la plus innovante et potentiellement révolutionnaire. Cette fonction permet aux utilisateurs de créer des instruments virtuels ou des effets audio entièrement nouveaux en utilisant uniquement le langage naturel. Imaginez pouvoir décrire textuellement le son que vous avez en tête – « un synthétiseur analogique chaud avec une légère distorsion et un chorus subtil » – et obtenir instantanément cet instrument prêt à être utilisé dans vos compositions.

La véritable innovation réside dans le fait que ces créations ne restent pas isolées. Chaque instrument ou effet généré via Spaces peut être partagé avec la communauté sous forme de mini-applications autonomes. D’autres utilisateurs peuvent alors découvrir ces créations, les télécharger, les modifier, les remixer et créer leurs propres variations. Cette approche collaborative transforme la création d’instruments numériques en une activité sociale et participative, à l’image de ce qui existe déjà dans les communautés de modding de jeux vidéo ou de développement open source.

On peut imaginer Spaces comme un synthétiseur modulaire construit avec des mots. Dans la synthèse modulaire traditionnelle, les musiciens assemblent physiquement ou virtuellement différents modules (oscillateurs, filtres, enveloppes, effets) en les connectant par des câbles pour créer des chaînes de traitement sonore complexes. Spaces transpose cette logique dans le domaine du langage : au lieu de connecter des modules, on décrit verbalement les caractéristiques sonores désirées et l’intelligence artificielle construit l’architecture correspondante.

Cette approche démocratise radicalement la création d’instruments numériques, un domaine traditionnellement réservé aux programmeurs maîtrisant des langages comme Max/MSP, Pure Data ou C++. Un musicien sans compétences en codage peut désormais concevoir des instruments uniques simplement en articulant ses idées. Cette barrière technique abaissée pourrait libérer une créativité jusqu’ici bridée par les limitations techniques.

Les implications pour l’innovation musicale sont considérables. Historiquement, l’évolution des genres musicaux a souvent été liée à l’apparition de nouveaux instruments ou technologies : le synthétiseur Moog et l’émergence de l’électronique progressive dans les années 1970, la boîte à rythmes TR-808 et la naissance du hip-hop, les plugins VST et l’explosion de la production bedroom. Spaces pourrait catalyser une nouvelle vague d’innovation sonore en permettant à chacun de devenir concepteur d’instruments.

Les enjeux techniques et éthiques de la génération musicale par machine learning

L’intégration de Producer.AI chez Google soulève des questions techniques complexes qui dépassent largement le simple cadre de la génération audio. L’une des préoccupations majeures concerne la traçabilité et l’authenticité des contenus générés par intelligence artificielle. Pour répondre à cette problématique, Google a implémenté SynthID, une technologie de watermarking invisible qui marque de manière indélébile les créations audio générées par Lyria 3.

SynthID fonctionne en intégrant des motifs imperceptibles à l’oreille humaine directement dans la structure spectrale du signal audio. Ces signatures numériques résistent aux transformations courantes comme la compression MP3, la conversion de format ou même la réenregistrement analogique. Cette traçabilité permet de distinguer automatiquement une œuvre générée par IA d’une production humaine, répondant ainsi aux préoccupations croissantes concernant la prolifération de contenus synthétiques dans l’écosystème musical.

Du point de vue du machine learning, Lyria 3 représente une prouesse technique considérable. Les modèles de génération musicale doivent gérer simultanément plusieurs dimensions de complexité : la cohérence harmonique, la structure temporelle, la variété timbrale, l’expressivité émotionnelle et la qualité audio brute. Contrairement aux modèles de langage qui travaillent avec des tokens discrets (mots ou sous-mots), les modèles audio doivent traiter des signaux continus avec une résolution temporelle extrêmement fine (généralement 44 100 échantillons par seconde pour la qualité CD).

Les architectures de réseaux de neurones utilisées pour Lyria 3 combinent probablement des transformers (pour capturer les dépendances à long terme dans la structure musicale) avec des réseaux de convolution (pour modéliser les textures sonores locales) et des VAE (Variational Autoencoders) ou des diffusion models (pour générer des formes d’onde de haute qualité). L’entraînement de tels modèles nécessite des infrastructures de calcul massives et des datasets soigneusement constitués.

La question des données d’entraînement soulève elle-même des enjeux éthiques délicats. Sur quelles œuvres musicales Lyria 3 a-t-il été entraîné ? Les artistes dont les compositions ont servi à former le modèle ont-ils donné leur consentement ? Sont-ils rémunérés d’une manière ou d’une autre ? Google reste relativement discret sur ces aspects, se contentant de mentionner avoir « respecté les droits d’auteur » sans détailler précisément ses accords avec les ayants droit.

| Aspect technique | Défi | Solution apportée par Lyria 3 |

|---|---|---|

| Cohérence harmonique | Éviter les dissonances involontaires | Modélisation des progressions d’accords |

| Structure temporelle | Créer des morceaux avec intro, couplets, refrain | Compréhension de la forme musicale |

| Qualité audio | Générer un son haute fidélité sans artefacts | Modèles de diffusion avancés |

| Contrôle utilisateur | Permettre des ajustements précis | Paramètres granulaires (tempo, tonalité, etc.) |

| Traçabilité | Identifier les contenus générés par IA | Watermarking SynthID |

L’impact potentiel sur l’industrie musicale et les créateurs

L’arrivée de Producer.AI et de Lyria 3 dans l’écosystème Google Labs intervient dans un contexte d’inquiétude croissante au sein de l’industrie musicale concernant l’intelligence artificielle. De nombreux musiciens, compositeurs et producteurs craignent que la démocratisation radicale de la création musicale ne dévalue leur travail, inonde le marché de contenus génériques et menace leurs moyens de subsistance.

Ces préoccupations ne sont pas infondées. Si n’importe qui peut générer en quelques secondes une musique de fond de qualité acceptable pour une vidéo YouTube, un podcast ou une publicité locale, pourquoi engager un compositeur professionnel ? Les plateformes de musique libre de droits comme AudioJungle ou Epidemic Sound pourraient voir leurs modèles économiques perturbés par des alternatives gratuites basées sur l’IA. Les compositeurs de musique fonctionnelle (génériques télévisés, sonneries, ambiances de jeux vidéo) se trouvent particulièrement exposés à cette concurrence automatisée.

Pourtant, l’histoire de la technologie musicale suggère une lecture plus nuancée. L’apparition des boîtes à rythmes dans les années 1980 n’a pas éliminé les batteurs, mais a créé de nouveaux genres musicaux et élargi les possibilités créatives. Les plugins VST n’ont pas rendu obsolètes les studios d’enregistrement professionnels, mais ont permis l’émergence d’une scène bedroom producer florissante. L’échantillonnage, initialement perçu comme une menace pour les musiciens de session, est devenu un art à part entière.

L’innovation de Producer.AI pourrait suivre une trajectoire similaire : non pas remplacer les musiciens, mais redéfinir les frontières de la création musicale. La plateforme pourrait devenir un outil d’esquisse rapide pour les professionnels, permettant de tester rapidement des idées d’arrangements avant de les réaliser avec des instruments réels. Elle pourrait servir d’assistant créatif, générant des variations inattendues qui inspirent de nouvelles directions artistiques.

Pour les artistes indépendants disposant de budgets limités, Lyria 3 pourrait démocratiser l’accès à des éléments de production autrefois coûteux : sections de cordes orchestrales, chœurs, arrangements complexes. Au lieu de renoncer à ces embellissements faute de moyens, un artiste solo pourrait les générer par IA, créant ainsi des œuvres plus ambitieuses. Cette démocratisation pourrait paradoxalement augmenter la diversité musicale en abaissant les barrières économiques à l’entrée.

Cependant, cette vision optimiste nécessite des garde-fous. L’industrie musicale devra développer de nouveaux cadres réglementaires et éthiques pour encadrer l’utilisation de l’IA générative. Questions à résoudre :

- Comment créditer les contributions créatives lorsqu’une œuvre est partiellement ou totalement générée par IA ?

- Qui détient les droits d’auteur sur une composition créée par Lyria 3 ? L’utilisateur qui a formulé la requête ? Google qui a développé le modèle ? Les artistes dont les œuvres ont servi à l’entraînement ?

- Les œuvres générées par IA doivent-elles être clairement étiquetées comme telles sur les plateformes de streaming ?

- Comment protéger les styles artistiques distinctifs contre l’imitation par IA sans le consentement des artistes originaux ?

- Faut-il établir des quotas ou des restrictions sur la monétisation de contenus entièrement générés par IA sur les plateformes comme Spotify ou YouTube Music ?

Google face à la concurrence : où se situe Producer.AI dans la course à l’innovation musicale

L’intégration de Producer.AI chez Google ne se fait pas en terrain vierge. Le marché de la génération musicale par intelligence artificielle connaît une effervescence remarquable avec de nombreux acteurs établis ou émergents. Comprendre le positionnement de Google nécessite d’examiner le paysage concurrentiel et les différentes approches technologiques adoptées par les différents acteurs.

Parmi les concurrents majeurs, on trouve des plateformes comme Suno, qui permet également de générer des chansons complètes à partir de descriptions textuelles. Suno a connu un succès viral grâce à son accessibilité et à la qualité surprenante de ses productions. Udio, développé par d’anciens chercheurs de Google DeepMind (ironiquement), propose une approche similaire avec un accent particulier sur le contrôle stylistique et la cohérence des paroles. Stable Audio, de Stability AI, mise sur la génération de samples et de boucles instrumentales de haute qualité pour les producteurs professionnels.

Chaque plateforme adopte des philosophies distinctes. Certaines privilégient la simplicité et l’accessibilité totale (générer une chanson en trois clics), tandis que d’autres visent les utilisateurs avancés avec des contrôles granulaires et des workflows complexes. Producer.AI tente visiblement de naviguer entre ces deux extrêmes, offrant une interface accessible en langage naturel tout en proposant des paramètres détaillés pour les utilisateurs souhaitant un contrôle plus fin.

L’avantage compétitif de Google réside dans son écosystème intégré. En connectant Producer.AI avec Veo (génération vidéo) et Nano Banana (génération d’images), Google propose une suite créative complète où musique, visuels et vidéos peuvent être co-créés de manière cohérente. Un utilisateur pourrait théoriquement concevoir un clip musical entier – paroles, musique, images et montage vidéo – sans jamais quitter l’environnement Google Labs. Cette intégration verticale représente un atout stratégique considérable que les acteurs spécialisés ne peuvent égaler.

Par ailleurs, l’infrastructure technique de Google offre une puissance de calcul et une capacité de scaling que peu d’entreprises peuvent rivaliser. Lyria 3 bénéficie des TPU (Tensor Processing Units) de Google, spécialement optimisés pour l’entraînement et l’inférence de grands modèles de machine learning. Cette puissance permet d’itérer rapidement sur les modèles, d’incorporer des datasets massifs et de servir des millions d’utilisateurs simultanément sans dégradation de performance.

Néanmoins, Google fait également face à des défis spécifiques. L’entreprise doit gérer sa réputation et ses relations délicates avec l’industrie du divertissement. Contrairement à des startups agiles qui peuvent prendre des risques réglementaires, Google opère sous un microscope constant et doit naviguer prudemment dans les eaux troubles du copyright et des droits d’auteur. Cette prudence institutionnelle pourrait ralentir l’innovation ou contraindre les fonctionnalités de manière à ne pas froisser les ayants droit.

Vers un futur où la technologie redéfinit la créativité musicale

L’aventure de Google avec Producer.AI et Lyria 3 illustre un défi fascinant : comment concevoir des outils d’intelligence artificielle qui amplifient la créativité humaine sans la supplanter ? Cette question dépasse largement le cadre de la musique et touche à des enjeux philosophiques fondamentaux sur la nature de l’art, de l’expression personnelle et du rôle de la technologie dans nos vies créatives.

La vision optimiste imagine un futur où l’IA devient un partenaire créatif plutôt qu’un remplaçant. Un compositeur pourrait dialoguer avec Lyria 3 comme avec un collaborateur, testant des idées, explorant des directions inattendues, obtenant des suggestions qui stimulent sa propre imagination. L’IA deviendrait un miroir créatif, reflétant et amplifiant les intentions de l’artiste tout en introduisant des variations surprenantes qui enrichissent le processus.

Dans cette perspective, la fonctionnalité Spaces apparaît comme particulièrement prometteuse. En permettant la création collaborative d’instruments et d’effets, elle cultive une communauté créative où les utilisateurs s’enrichissent mutuellement. On pourrait imaginer l’émergence de véritables écoles stylistiques basées sur des collections d’instruments partagés, où la signature sonore d’un mouvement artistique reposerait sur un ensemble de mini-applications Spaces développées collectivement.

L’éducation musicale pourrait également être transformée. Des outils comme Producer.AI permettent d’expérimenter instantanément avec des concepts théoriques qui nécessitaient auparavant des années de pratique instrumentale. Un étudiant pourrait explorer concrètement les différences entre une progression harmonique majeure et mineure, comprendre viscéralement l’impact d’un changement de tempo, ou découvrir comment différentes instrumentations affectent l’émotion d’un morceau.

Toutefois, cette démocratisation soulève également des interrogations sur l’homogénéisation culturelle. Si des millions de personnes utilisent le même modèle entraîné sur les mêmes datasets, risque-t-on de voir émerger une esthétique musicale uniformisée, où toutes les productions se ressemblent ? Les biais inhérents aux données d’entraînement pourraient-ils marginaliser certains genres musicaux ou traditions culturelles sous-représentées dans les datasets ?

Google devra naviguer ces tensions avec sagesse. L’entreprise affirme vouloir « valoriser le talent artistique humain », mais cette déclaration demeure vague. Concrètement, cela pourrait signifier développer des fonctionnalités qui favorisent l’expression personnelle plutôt que la génération standardisée, encourager la diversité stylistique plutôt que la reproduction de hits commerciaux, et créer des mécanismes de rémunération équitables pour les artistes dont le travail contribue indirectement à la qualité du modèle.

Le défi technique sous-jacent est immense : comment concevoir un système d’IA musical suffisamment puissant pour être utile, mais suffisamment flexible pour respecter l’individualité créative ? Comment éviter que Lyria 3 ne devienne un moule qui formate la créativité plutôt qu’un outil qui la libère ? Ces questions n’ont pas de réponses simples et nécessiteront une collaboration continue entre ingénieurs, artistes, théoriciens de la musique et philosophes.

L’impact à long terme de Producer.AI dépendra largement de la manière dont Google choisira de positionner l’outil. S’il devient un simple générateur de musique d’ascenseur pour contenus YouTube, son influence restera limitée. Mais s’il évolue vers une véritable plateforme d’exploration créative, stimulant l’innovation et démocratisant l’expression musicale, il pourrait marquer un tournant historique comparable à l’invention du synthétiseur ou de l’enregistrement multipiste.

L’aventure ne fait que commencer, et le futur de la création musicale assistée par machine learning reste largement ouvert. Une chose est certaine : les frontières entre humain et machine, entre créativité organique et génération algorithmique, continueront de se brouiller. La question n’est plus de savoir si l’IA transformera la musique, mais comment nous choisirons collectivement de guider cette transformation.

Producer.AI peut-il vraiment remplacer un producteur musical professionnel ?

Producer.AI est conçu comme un outil d’assistance créative plutôt qu’un remplacement des professionnels. Bien que capable de générer des compositions complètes, il manque la sensibilité contextuelle, l’expertise émotionnelle et la compréhension culturelle nuancée qu’apporte un producteur humain expérimenté. Les artistes établis comme The Chainsmokers l’utilisent pour l’exploration créative et non pour la production finale de leurs albums. L’outil excelle dans la génération de démos rapides, de musiques fonctionnelles ou l’expérimentation sonore, mais la touche humaine reste essentielle pour les œuvres artistiques ambitieuses.

Comment fonctionne exactement Lyria 3 pour générer de la musique ?

Lyria 3 s’appuie sur des réseaux de neurones profonds entraînés sur des millions de compositions musicales variées. Le modèle analyse simultanément plusieurs dimensions : structure harmonique, progressions d’accords, patterns rythmiques, timbres instrumentaux et expressivité émotionnelle. Il utilise probablement une combinaison de transformers pour capturer les dépendances à long terme, de réseaux convolutifs pour les textures locales, et de diffusion models pour générer l’audio haute fidélité. L’utilisateur formule une requête en langage naturel, que le système traduit en paramètres musicaux avant de synthétiser la composition correspondante avec des contrôles granulaires sur tempo, tonalité et alignement des paroles.

Qui détient les droits d’auteur sur une chanson créée avec Producer.AI ?

La question des droits d’auteur sur les œuvres générées par IA reste juridiquement complexe et évolutive. Généralement, l’utilisateur qui formule la requête créative et ajuste les paramètres pourrait revendiquer certains droits, mais la législation varie selon les juridictions. Google intègre la technologie SynthID pour marquer toutes les créations, facilitant leur traçabilité. Les conditions d’utilisation de Google Labs précisent probablement les termes de propriété intellectuelle, mais la jurisprudence concernant la créativité assistée par IA reste en développement. Il est recommandé de consulter les termes d’utilisation spécifiques et éventuellement un conseiller juridique pour les usages commerciaux.

Quelles sont les principales différences entre Producer.AI et ses concurrents comme Suno ou Udio ?

Producer.AI se distingue par son intégration dans l’écosystème Google Labs, permettant une synergie avec Veo (vidéo) et Nano Banana (images) pour créer des projets multimédias complets. La fonctionnalité Spaces, qui permet de créer et partager des instruments virtuels personnalisés, constitue une innovation unique. Tandis que Suno privilégie la simplicité d’usage et Udio mise sur le contrôle stylistique avancé, Producer.AI tente d’équilibrer accessibilité et profondeur technique. L’infrastructure de Google offre également une puissance de calcul et une capacité de scaling supérieures, avec l’utilisation de TPU optimisés pour le machine learning musical.

La technologie SynthID peut-elle vraiment empêcher les abus de contenu généré par IA ?

SynthID intègre des watermarks imperceptibles directement dans la structure spectrale de l’audio généré par Lyria 3, résistant aux transformations courantes comme la compression ou la conversion de format. Cette technologie permet d’identifier avec précision les contenus créés par IA, aidant à lutter contre la désinformation et les deepfakes audio. Cependant, aucun système de watermarking n’est absolument infaillible face à des tentatives sophistiquées de suppression. SynthID représente une couche de sécurité importante mais doit être combinée avec d’autres mécanismes (vérification de sources, éducation du public, réglementations) pour une approche globale de l’authenticité des contenus musicaux.

Audience de l'article

1,163 vuesArticle précédent

Découvrez le Sleep Tracker Révolutionnaire : Adieu les Gadgets Intrusifs Grâce à la Technologie Invisible et aux Formes Douces !

Article suivant

Azamara Journey lance la saison des croisières au port de Séville

nadia

Bonjour, je m'appelle Nadia et j'ai 36 ans. Je suis une journaliste passionnée par la technologie. Bienvenue sur mon site web où je partage mes articles et mes découvertes dans le monde de la tech.

Tous ses articlesSur le même sujet

#GoogleIntel et Google unissent leurs forces pour révolutionner l’infrastructure de l’intelligence artificielle

L’annonce d’une collaboration pluriannuelle entre Intel et Google marque un tournant décisif dans l’évolution des inf...

Google ajuste son IA Gemini pour protéger les jeunes de la dépendance – RTBF Actus

Le géant américain de la technologie annonce une série de mesures pour renforcer la sécurité numérique de son…

Pixels : Découvrez la mise à jour d’avril 2026 et les bugs résolus par Google

Google vient de déployer la mise à jour d’avril 2026 pour l’ensemble de sa gamme Pixel, apportant une…

Articles similaires

L’intelligence artificielle amplifie-t-elle le sentiment du syndrome de l’imposteur ?

En 2026, l intelligence artificielle n’est plus une curiosité technologique: elle est devenue un outil omniprésent, c...

Les synthèses IA de Google souvent erronées : une étude alerte sur leurs limites

Des résumés automatiques qui trompent des millions d’internautes chaque jour Depuis que Google a déployé ses synthèse...

Fatigue cognitive liée à l’IA : quand l’usage intensif de l’intelligence artificielle surcharge les professionnels

Fatigue cognitive liée à l’IA en milieu professionnel : comprendre le phénomène et les enjeux de 2026 Depuis…

Commentaires 0

Populaires · Récents