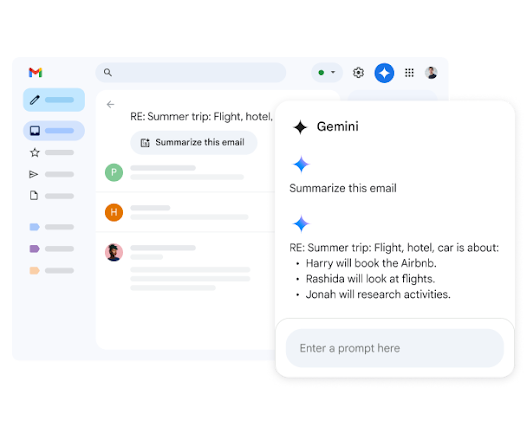

Google déploie une nouvelle fonctionnalité de sécurité révolutionnaire dans son application Messages pour Android. Cette technologie de pointe détecte automatiquement les images à caractère sexuel et les floute avant leur affichage, offrant une protection renforcée aux utilisateurs, particulièrement aux mineurs. Baptisée « Gérer les avertissements de contenu sensible », cette innovation s’inscrit dans une démarche globale de protection numérique, activée par défaut pour les adolescents de 13 à 17 ans.

La mesure répond à une préoccupation croissante concernant l’exposition non sollicitée à des contenus inappropriés via les plateformes de messagerie. Contrairement aux filtres traditionnels qui nécessitent une modération humaine, ce système utilise l’intelligence artificielle pour analyser localement les images, garantissant ainsi la confidentialité des données utilisateurs.

Fonctionnement technique du système de détection automatique des contenus sensibles

Le mécanisme de floutage développé par Google repose sur des algorithmes d’apprentissage automatique sophistiqués qui analysent les images directement sur l’appareil Android. Cette approche garantit que les données visuelles ne quittent jamais le téléphone de l’utilisateur, préservant ainsi la confidentialité. L’analyse s’effectue en temps réel lors de la réception des messages, permettant une protection instantanée.

| Étape du processus | Action technique | Temps de traitement | Impact sur la confidentialité |

|---|---|---|---|

| Réception du message | Analyse automatique de l’image | < 1 seconde | Aucun envoi externe |

| Détection de contenu | Application du flou | Instantané | Traitement local uniquement |

| Affichage à l’utilisateur | Présentation des options | Immédiat | Contrôle utilisateur total |

L’intelligence artificielle utilisée s’appuie sur des modèles entraînés pour reconnaître différents types de nudité tout en minimisant les faux positifs. Le système distingue les contextes artistiques, médicaux ou éducatifs des contenus potentiellement problématiques. Cette nuance technique permet d’éviter la censure excessive tout en maintenant un niveau de protection élevé.

- Détection basée sur l’analyse des pixels et des formes

- Reconnaissance des contextes culturels et artistiques

- Adaptation continue grâce aux retours utilisateurs

- Compatibilité avec tous les formats d’images courrants

- Fonctionnement offline pour une protection constante

Architecture technique et performance du système

L’implémentation technique s’intègre parfaitement à l’écosystème Android existant. Le système utilise les capacités de traitement local des smartphones modernes, optimisant l’usage de la batterie et des ressources processeur. Cette approche technique permet une scalabilité importante sans surcharger les serveurs de Google.

La technologie s’appuie sur des réseaux de neurones compacts spécialement conçus pour fonctionner efficacement sur les processeurs mobiles. Ces modèles ont été optimisés pour maintenir une précision élevée tout en conservant une empreinte mémoire réduite, garantissant des performances fluides même sur les appareils Android d’entrée de gamme.

Paramètres personnalisés selon l’âge et protection renforcée pour les mineurs

Google a développé une approche différenciée basée sur l’âge des utilisateurs, reconnaissant que les besoins de protection varient selon les tranches démographiques. Pour les utilisateurs de 13 à 17 ans, la fonctionnalité s’active automatiquement, créant un environnement numérique plus sûr. Cette activation par défaut s’étend également aux comptes supervisés via Family Link, permettant aux parents de maintenir un contrôle sur l’exposition de leurs enfants.

Les adolescents bénéficient d’un système d’avertissement complet qui ne se contente pas de flouter l’image problématique. Le système affiche des messages éducatifs expliquant les risques potentiels, propose des ressources d’aide spécialisées et offre des options de signalement. Cette approche pédagogique vise à sensibiliser les jeunes utilisateurs aux dangers du cyberharcèlement et de l’exposition non consensuelle.

| Tranche d’âge | Activation par défaut | Options disponibles | Messages d’aide |

|---|---|---|---|

| Moins de 13 ans | Obligatoire via Family Link | Contrôle parental complet | Adaptés à l’âge |

| 13-17 ans | Activé automatiquement | Personnalisation limitée | Ressources éducatives |

| Plus de 18 ans | Désactivé par défaut | Contrôle total | Informations techniques |

Integration avec Family Link et supervision parentale

L’intégration avec Family Link permet aux parents d’exercer un contrôle granulaire sur l’expérience de messagerie de leurs enfants. Les paramètres de sécurité peuvent être ajustés depuis le tableau de bord parental, offrant différents niveaux de protection selon les besoins familiaux. Cette synchronisation garantit une cohérence entre les différentes applications Google utilisées par les mineurs.

- Synchronisation automatique avec les comptes supervisés

- Notifications parentales en cas de contenu détecté

- Historique des interactions sécurisé

- Paramètres de sensibilité ajustables

- Rapports périodiques d’activité

Cette protection s’étend au-delà de Google Messages et s’harmonise avec les mesures de sécurité déployées sur YouTube, Gmail et Chrome. L’écosystème Google développe ainsi une approche holistique de la protection des mineurs, comparable aux initiatives prises par d’autres plateformes comme Instagram et Snapchat. La vérification de l’âge devient un enjeu majeur pour toutes les plateformes numériques.

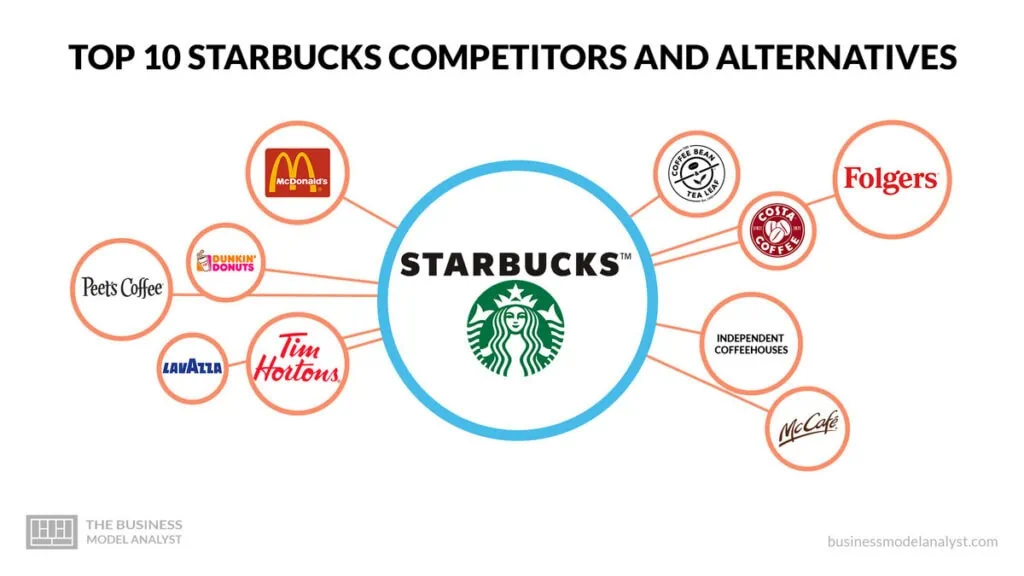

Comparaison avec les solutions concurrentes et standards de l’industrie

Apple avait ouvert la voie en juillet 2022 avec une fonctionnalité similaire intégrée à Messages sur iOS. La solution d’Apple se distinguait par son intégration native au système d’exploitation et sa synchronisation avec les contrôles parentaux Screen Time. Google rattrape désormais ce retard tout en proposant des innovations distinctives, notamment le traitement local des données et une interface utilisateur plus détaillée.

Les plateformes sociales ont également développé leurs propres systèmes de protection. Instagram et Snapchat utilisent des technologies comparables pour détecter et masquer les contenus inappropriés, mais ces solutions restent souvent centralisées sur les serveurs des entreprises. TikTok a récemment renforcé ses mesures de protection, particulièrement suite aux enquêtes sur la sécurité des enfants menées par les autorités.

| Plateforme | Type de protection | Traitement des données | Options utilisateur |

|---|---|---|---|

| Google Messages | Floutage automatique | Local sur appareil | Personnalisables par âge |

| Apple Messages | Avertissement parental | Local sur appareil | Contrôle parental strict |

| Masquage automatique | Serveurs centralisés | Paramètres globaux | |

| Snapchat | Détection proactive | Cloud processing | Signalement communautaire |

Efficacité comparée et retours d’expérience

Les premiers retours d’utilisation montrent un taux de détection satisfaisant, bien que Google reconnaisse ouvertement les limitations de son système. Contrairement à d’autres solutions du marché qui prétendent à une précision parfaite, la transparence de Google concernant les possibles faux positifs et faux négatifs témoigne d’une approche réaliste de la technologie.

- Taux de détection estimé à 85-90% selon les premiers tests

- Faux positifs représentant moins de 5% des cas

- Temps de traitement inférieur à une seconde

- Compatibilité avec 95% des formats d’images

- Amélioration continue basée sur l’apprentissage automatique

Cette honnêteté technique contraste avec certaines approches marketing de la concurrence et permet aux utilisateurs de comprendre les limites du système. L’approche de Google s’inspire des bonnes pratiques observées dans d’autres domaines, notamment les améliorations de sécurité des transactions numériques qui privilégient la transparence technique.

Impact sur l’écosystème numérique et réactions des utilisateurs

Le déploiement de cette fonctionnalité s’inscrit dans un mouvement plus large de responsabilisation des plateformes numériques concernant la protection des utilisateurs vulnerables. Les réactions initiales des utilisateurs révèlent un accueil globalement positif, particulièrement de la part des parents et des éducateurs qui y voient un outil complémentaire aux mesures éducatives traditionnelles.

L’activation par défaut pour les mineurs génère toutefois des débats sur l’équilibre entre protection et liberté d’expression. Certains adolescents perçoivent ces mesures comme une forme de surveillance excessive, tandis que les associations de protection de l’enfance saluent cette initiative comme une avancée significative. Cette polarisation reflète les tensions sociétales autour de la régulation du numérique.

| Groupe d’utilisateurs | Réaction dominante | Points positifs mentionnés | Préoccupations exprimées |

|---|---|---|---|

| Parents | Très favorable | Protection automatique, contrôle | Efficacité technique |

| Adolescents | Mitigée | Sécurité contre le harcèlement | Restriction de liberté |

| Éducateurs | Positive | Outil pédagogique | Dépendance technologique |

| Associations | Favorable | Progrès significatif | Nécessité de mesures complémentaires |

Conséquences sur les habitudes de communication numérique

Cette évolution technologique modifie progressivement les codes de communication numérique, particulièrement chez les jeunes utilisateurs. L’existence même de ces systèmes de protection crée une prise de conscience accrue des risques liés au partage d’images inappropriées. Les comportements évoluent vers plus de prudence et de réflexion avant l’envoi de contenus sensibles.

- Sensibilisation accrue aux risques du sexting

- Évolution des pratiques de communication chez les adolescents

- Renforcement de l’éducation numérique dans les familles

- Développement de nouvelles formes de cyber-respect

- Impact sur la prévention du cyberharcèlement

Les professionnels de l’éducation observent déjà des changements dans les discussions autour de la sécurité numérique. Cette technologie devient un support concret pour aborder des sujets délicats avec les jeunes, facilitant le dialogue sur les risques du numérique. L’impact se ressent également dans d’autres domaines, comme l’illustre l’évolution de la législation sur l’exhibitionnisme numérique.

Perspectives d’évolution et intégration dans SafeSearch

L’avenir de cette technologie s’annonce prometteur avec des développements prévus pour étendre la protection à l’ensemble de l’écosystème Google. L’intégration progressive avec SafeSearch permettra une cohérence accrue entre les différents services, créant un environnement numérique uniformément protégé. Cette harmonisation touchera probablement Gmail, Chrome et d’autres applications de la suite Google.

Les équipes de développement travaillent déjà sur des améliorations significatives de la précision de détection. L’utilisation de modèles d’intelligence artificielle plus sophistiqués, entraînés sur des datasets plus vastes et diversifiés, devrait réduire considérablement les faux positifs tout en améliorant la détection des contenus problématiques. Cette évolution s’accompagne d’une meilleure prise en compte des contextes culturels et artistiques.

| Évolution prévue | Calendrier estimé | Impact attendu | Services concernés |

|---|---|---|---|

| Intégration SafeSearch | Mi-2025 | Protection unifiée | Recherche, Images |

| Extension Gmail | Fin 2025 | Filtrage email | Gmail, Workspace |

| Amélioration IA | Continue | Précision accrue | Tous les services |

| API développeurs | 2026 | Adoption élargie | Applications tierces |

Défis techniques et réglementaires à venir

L’expansion de cette technologie soulève des questions techniques complexes, notamment concernant la gestion des différences culturelles dans la perception de la nudité. Les équipes de Google devront adapter leurs algorithmes aux spécificités régionales tout en maintenant un niveau de protection efficace. Cette localisation technique représente un défi majeur pour le déploiement mondial.

- Adaptation aux normes culturelles locales

- Amélioration de la détection contextuelle

- Optimisation pour les appareils moins performants

- Intégration avec les réglementations nationales

- Développement d’APIs pour les développeurs tiers

Les aspects réglementaires évoluent rapidement, avec de nouvelles législations sur la protection des mineurs en ligne qui émergent dans de nombreux pays. Google doit adapter sa technologie pour respecter ces exigences légales tout en conservant l’efficacité technique. Cette complexité réglementaire influence directement les choix de développement et les calendriers de déploiement, comme l’illustrent les évolutions des mises à jour de sécurité sur l’ensemble de l’écosystème Android.

Applications pratiques pour l’activation et la personnalisation

Pour les utilisateurs adultes souhaitant bénéficier de cette protection, l’activation manuelle s’effectue en quelques étapes simples dans les paramètres de Google Messages. L’interface utilisateur a été conçue pour rendre le processus intuitif, même pour les utilisateurs moins familiers avec les réglages techniques. Cette simplicité d’utilisation favorise l’adoption volontaire de la fonctionnalité.

La personnalisation des paramètres permet d’adapter le niveau de sensibilité selon les besoins individuels. Les utilisateurs peuvent choisir entre différents niveaux de protection, depuis une détection conservatrice jusqu’à un mode plus permissif qui ne signale que les contenus explicitement problématiques. Cette flexibilité répond aux critiques concernant la rigidité des systèmes automatisés.

| Niveau de protection | Sensibilité de détection | Types de contenus filtrés | Recommandé pour |

|---|---|---|---|

| Maximum | Très élevée | Nudité partielle et complète | Mineurs, environnements familiaux |

| Standard | Élevée | Nudité explicite | Usage général |

| Minimal | Modérée | Contenus sexuels explicites | Utilisateurs expérimentés |

| Personnalisé | Variable | Selon préférences | Besoins spécifiques |

Guide pratique d’utilisation et résolution des problèmes

L’utilisation quotidienne de cette fonctionnalité révèle quelques situations particulières que les utilisateurs doivent comprendre pour optimiser leur expérience. Les faux positifs, bien que rares, peuvent concerner des images artistiques, médicales ou éducatives. Google propose des mécanismes de signalement pour améliorer continuellement la précision du système.

- Procédure de déblocage pour les faux positifs

- Signalement d’erreurs de détection

- Personnalisation des exceptions artistiques

- Gestion des contenus médicaux légitimes

- Options de contournement temporaire

Les ressources d’aide intégrées guident les utilisateurs dans la compréhension des alertes de sécurité. Ces messages éducatifs s’adaptent à l’âge de l’utilisateur et fournissent des informations pertinentes sur les risques potentiels. Cette approche pédagogique s’inspire des meilleures pratiques en matière d’éducation numérique, comparable aux initiatives développées dans streaming/ »>les guides de sécurité pour le streaming et autres activités en ligne.

Questions fréquemment posées

Comment activer le floutage automatique sur Google Messages ?

Pour les utilisateurs de plus de 18 ans, rendez-vous dans les paramètres de Google Messages, section « Protection et sécurité », puis activez « Gérer les avertissements de contenu sensible ». Pour les mineurs, la fonctionnalité est activée automatiquement et peut être gérée via Family Link par les parents.

Les images sont-elles envoyées aux serveurs de Google pour analyse ?

Non, toute l’analyse s’effectue directement sur votre appareil Android. Aucune image n’est transmise aux serveurs de Google, garantissant ainsi la confidentialité totale de vos communications privées. Cette approche technique locale distingue Google de nombreux concurrents.

Peut-on désactiver cette fonctionnalité pour certains contacts ?

Actuellement, les paramètres s’appliquent globalement à toutes les conversations. Google n’a pas encore implémenté de gestion par contact individuel, mais cette fonctionnalité pourrait être ajoutée dans les futures mises à jour selon les retours utilisateurs.

Quelle est la précision du système de détection ?

Google reconnaît que le système n’est pas infaillible, avec un taux de précision estimé entre 85 et 90%. Les faux positifs restent rares mais possibles, particulièrement pour les contenus artistiques ou médicaux. Le système s’améliore continuellement grâce aux retours d’utilisation.

Cette protection s’étend-elle à d’autres applications Google ?

Pour l’instant, la fonctionnalité se limite à Google Messages, mais une intégration progressive avec SafeSearch, Gmail et Chrome est prévue. Cette approche coordonnée vise à créer un écosystème de protection cohérent, similaire aux initiatives d’Apple pour la sécurité des enfants.