En bref

- Tesla annonce un cap symbolique : plus de 8 milliards de miles parcourus avec le FSD en mode supervision par les conducteurs.

- La courbe d’usage s’est emballée : environ 6 millions de miles en 2021, 80 millions en 2022, 670 millions en 2023, 2,25 milliards en 2024, 4,25 milliards en 2025, puis 1 milliard supplémentaire sur les 50 premiers jours de 2026.

- Sur le dernier cycle de 12 mois publié pour l’Amérique du Nord, Tesla indique un accident “majeur” tous les 5 300 676 miles avec FSD supervisé activé, contre 2 175 763 miles en conduite manuelle avec aides actives, et 855 132 miles sans aides actives.

- À ce rythme, la barre des 10 milliards de miles FSD supervisé paraît atteignable en 2026, ce qui alimente le débat sur la “longue traîne” des scénarios rares.

- Entre promesses, scepticisme et usages réels, la conduite assistée de Tesla continue de polariser, surtout quand on prononce “voiture autonome”.

Huit milliards. Le chiffre a quelque chose d’abstrait, comme ces distances interstellaires qu’on lit sans réussir à les “sentir”. Et pourtant, dans le quotidien des conducteurs Tesla, ce cap raconte une histoire très concrète : celle d’une technologie de conduite assistée utilisée massivement, jour après jour, sur autoroute, en périphérie, dans les embouteillages, et parfois dans ces rues où l’on se demande déjà comment un humain garde son calme.

Le jalon a été confirmé par Tesla via une mise à jour publique : la flotte a dépassé 8 milliards de miles parcourus avec le FSD en mode supervision. En clair : le système conduit, mais le conducteur surveille, mains prêtes, cerveau allumé. Ce détail change tout, et c’est aussi là que les malentendus naissent. Parce que beaucoup entendent “FSD” et imaginent “voiture autonome”. Or, la réalité, elle, est plus nuancée, plus terre-à-terre, et parfois un peu frustrante.

Ce qui intrigue, c’est l’accélération : la même communauté qui discutait encore timidement de quelques millions de miles en 2021 parle maintenant d’un milliard engrangé en moins de deux mois début 2026. Comment expliquer cette montée en puissance, et surtout, qu’est-ce que ces chiffres disent réellement sur la sécurité et sur l’évolution de la mobilité ?

8 milliards de miles FSD supervisé : ce que le chiffre raconte vraiment

Le premier réflexe, quand on lit “8 milliards de miles”, c’est d’y voir un concours de taille. Sauf qu’ici, le volume a un sens pratique : chaque mile parcouru sous supervision ajoute des situations de conduite réelles, avec leurs détails pénibles que les simulations gèrent mal. Les travaux, la pluie fine qui rend les marquages invisibles, le scooter qui surgit entre deux files, le panneau temporaire tordu par le vent… Voilà le genre de scènes qui finissent par “faire” ou “défaire” une voiture autonome digne de ce nom.

La progression annuelle donne le tournis. Des chiffres relayés par un observateur bien connu de l’actualité Tesla montrent une courbe presque exponentielle : environ 6 millions de miles en 2021, 80 millions en 2022, 670 millions en 2023, 2,25 milliards en 2024, 4,25 milliards en 2025. Et, début 2026, 1 milliard supplémentaire en 50 jours. Dit autrement : ce qui prenait des années à accumuler arrive désormais en quelques semaines.

Dans la vraie vie, ça se traduit par des scènes banales. À Lille, “Sofiane, 41 ans, commercial itinérant”, raconte qu’il active le FSD supervisé “surtout sur les longs rubans d’autoroute”, quand la monotonie fatigue plus vite qu’on ne l’admet. Il garde la main proche du volant, mais apprécie cette sensation étrange : la voiture gère la file, anticipe les ralentissements, et lui laisse une marge mentale. Sauf que, précise-t-il, “au péage ou dès qu’un camion fait n’importe quoi, c’est retour immédiat aux commandes”. Ce va-et-vient permanent, c’est précisément le quotidien du FSD supervisé.

Et puis il y a la question qui gratte : pourquoi cette adoption s’accélère-t-elle ? Tesla a plusieurs leviers. La flotte grandit. Des essais gratuits reviennent périodiquement. Et les projets de robotaxis, là où ils existent, poussent mécaniquement le compteur. Ceux qui suivent les discussions sur les tarifs reconnaîtront aussi un facteur très humain : quand un abonnement baisse, quand une période d’essai tombe au bon moment, on teste “pour voir”… et parfois on garde.

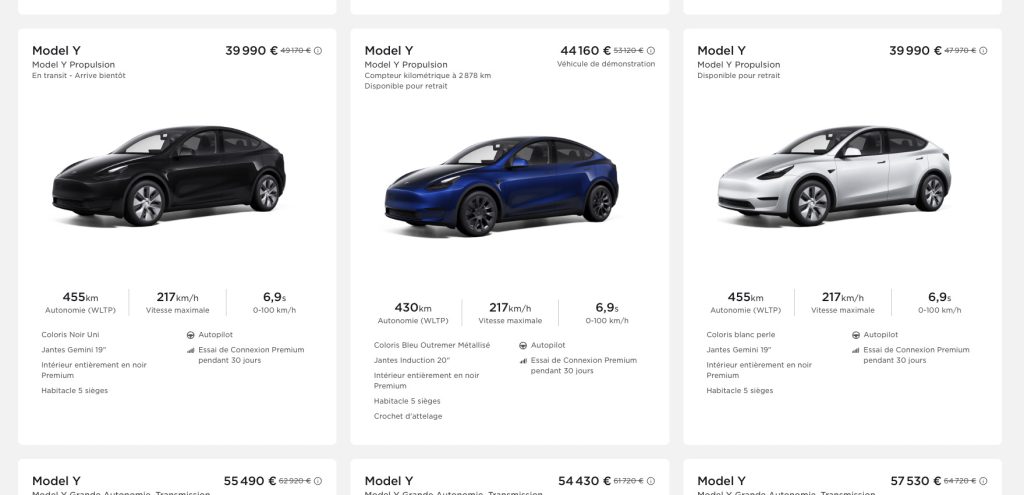

Pour situer l’offre, un détour par les options fait du bien : l’article les options tarifaires du FSD détaille comment Tesla structure l’accès à cette fonction selon les marchés et les périodes. Et, entre nous soit dit, c’est souvent là que se joue la bascule : l’envie technophile ne suffit pas, il faut aussi que le portefeuille suive.

Ce qui nous amène naturellement à la question suivante : ces milliards de miles rendent-ils la route plus sûre, ou donnent-ils seulement une impression de contrôle ?

Sécurité du FSD supervisé : lire les chiffres sans se raconter d’histoires

Les statistiques de sécurité autour du FSD supervisé font réagir, parfois très fort. Tesla a publié des données sur une période récente de 12 mois en Amérique du Nord, tous types de routes confondus. Le chiffre mis en avant : un accident majeur tous les 5 300 676 miles lorsque le FSD supervisé est activé. En conduite manuelle avec systèmes de sécurité actifs, Tesla annonce un accident majeur tous les 2 175 763 miles. Sans aides actives, on tombe à 855 132 miles. Et la moyenne américaine indiquée sur la même période s’établit à un accident majeur tous les 660 164 miles.

Sur le papier, l’écart est énorme. Mais bon, soyons honnêtes : il faut résister à deux tentations. La première, c’est de crier “preuve absolue”. La seconde, c’est de balayer en disant “statistiques bidon”. La réalité se niche dans les détails : qu’est-ce qu’un “accident majeur” selon Tesla ? Comment la flotte se répartit entre autoroute, urbain dense, routes secondaires ? Quel profil de conducteur active le FSD (plutôt prudent, plutôt technophile, plutôt habitué) ?

Tesla indique aussi des volumes : sur la période mesurée, environ 4,39 milliards de miles ont été parcourus avec le FSD supervisé. Et le total d’accidents majeurs rapporté dans cette catégorie serait de 830. À comparer avec 16 131 en conduite manuelle avec sécurité active, et 250 en conduite manuelle sans sécurité active (un groupe plus petit, donc un chiffre brut difficile à comparer sans exposition identique). Ces nuances comptent, car un chiffre brut, sans contexte d’usage, a vite fait de devenir une arme de débat sur un plateau télé.

Une scène aide à comprendre. “Claire, 33 ans, infirmière à Montpellier”, roule tôt le matin. Elle active le FSD supervisé sur une voie rapide bien marquée. Tout se passe bien jusqu’à une bretelle où un véhicule s’insère au dernier moment. Le système freine de façon un peu plus appuyée qu’elle ne l’aurait fait. Rien de dangereux, mais assez pour surprendre. Résultat : elle conserve le FSD pour les longues portions régulières, mais reprend la main dès que l’environnement devient “social”, c’est-à-dire rempli d’humains imprévisibles. Voilà le truc : une grande part de la sécurité perçue vient aussi du fait que les utilisateurs apprennent où le système est à l’aise, et où il devient maladroit.

Les chiffres ont donc une valeur, mais ils demandent une lecture mature. Ils suggèrent que le FSD supervisé, utilisé dans de bonnes conditions et avec un conducteur attentif, peut réduire le risque sur certains trajets. Ils ne prouvent pas qu’on peut lâcher prise. Ils ne transforment pas, par magie, une conduite assistée en voiture autonome sans limites.

Et c’est précisément ce point qui ouvre la porte au sujet le plus sensible : l’objectif des 10 milliards de miles, et ce que Tesla pense pouvoir en tirer.

Vers 10 milliards de miles : la “longue traîne” et l’obsession des cas rares

Dans les propos récents associés à Tesla et à Elon Musk, un chiffre revient comme un refrain : environ 10 milliards de miles de données d’entraînement pour viser une conduite sans supervision. La formule “la réalité a une longue traîne de complexité” a été reprise et commentée, parce qu’elle décrit très bien le problème. Conduire, ce n’est pas seulement respecter le code. C’est survivre à l’imprévu. Et l’imprévu, par définition, se cache dans les coins.

Les 8 milliards de miles parcourus en FSD supervisé ne sont pas exactement “les miles totaux de la planète Tesla”. Mais ils comptent beaucoup, car ils correspondent à des trajets où le système prend des décisions, et où chaque reprise en main, chaque hésitation, chaque micro-événement peut nourrir l’évolution du logiciel. C’est presque une école de conduite à l’échelle industrielle. Sauf que l’élève, ici, est une pile de réseaux neuronaux.

À Paris, “Romain, 29 ans, développeur”, s’amuse d’un détail : le FSD gère bien les files sur le périphérique, mais “n’aime pas les comportements de dernière seconde”. Or, c’est précisément ce que les conducteurs parisiens font le mieux, parfois à leur corps défendant. Romain dit avoir remarqué une amélioration sur certains scénarios entre deux mises à jour, puis une régression ponctuelle ailleurs. Franchement, c’est aussi ce qui fatigue les utilisateurs : l’impression que l’apprentissage n’est pas linéaire, qu’un progrès peut s’accompagner d’une bizarrerie nouvelle, comme si le système changeait de personnalité au fil des versions.

Cette non-linéarité se comprend : quand Tesla modifie des modèles “end-to-end” (où la chaîne perception-décision-commande est fortement intégrée), une amélioration sur la gestion d’un carrefour peut influencer la douceur d’un freinage ailleurs. Les ingénieurs appellent ça des compromis. Les conducteurs, eux, appellent ça “pourquoi elle fait ça aujourd’hui ?”.

Sur la route vers les 10 milliards, l’accélération observée en 2025-2026 joue comme un turbo. Si un milliard de miles arrive en 50 jours, le compteur peut grimper très vite. Mais l’essentiel reste la diversité des situations : rouler un million de miles sur une autoroute rectiligne ne vaut pas un million de miles dans un centre-ville mal signalé, sous la pluie, avec des travaux. C’est injuste, mais c’est la route.

À ce stade, un autre élément devient impossible à ignorer : le robotaxi et le Cybercab, qui changent la nature même des miles engrangés. Et c’est là que l’histoire devient franchement politique, économique… et un peu émotionnelle.

Robotaxi, Cybercab et supervision : quand les miles changent de nature

Un mile parcouru par un particulier pour aller au travail n’a pas la même “saveur” qu’un mile réalisé dans un service de transport. Le premier est dispersé, intime, rempli de choix personnels. Le second est répétitif, structuré, soumis à des contraintes d’exploitation, et donc potentiellement très “rentable” en données et en apprentissage. Si l’on cherche à comprendre pourquoi Tesla met en avant ces cumuls de miles, il faut regarder ce que ces miles autorisent derrière : des comparaisons de performance, des itérations rapides, et un récit industriel qui se nourrit de chiffres.

Dans ce contexte, la question du Cybercab revient tout le temps. Prix, disponibilité, calendrier… tout le monde a un avis, et beaucoup veulent une date ferme. Pour ceux qui suivent les annonces et les discussions autour d’Elon Musk, le papier le prix évoqué pour le Cybercab donne un aperçu des attentes et des projections, avec ce que cela implique pour un usage “robotaxi”.

Mais il y a un point que les débats oublient souvent : même avec un robotaxi, la supervision ne disparaît pas par magie. Elle change de forme. Elle peut devenir une supervision à distance, une supervision opérateur, une supervision par zones géographiques, ou une supervision réglementaire. Et c’est là que beaucoup de lecteurs tiquent : la promesse “voiture autonome” fait rêver, mais le mot “supervision” rappelle qu’on parle de sécurité publique, pas d’un gadget de salon.

Une petite scène, très 2026, résume bien le dilemme. “Inès, 46 ans, gérante d’un restaurant à Lyon”, se dit prête à tester un robotaxi pour les retours tardifs d’équipe, parce que l’idée d’un transport électrique et régulier la rassure. Mais elle ajoute aussitôt : “S’il y a un opérateur qui peut reprendre la main quand ça part de travers, ça me va. Si on me dit que c’est 100% autonome partout, tout le temps, là je bloque.” Ce n’est pas de la technophobie. C’est un instinct de prudence, et il est très répandu.

Dans les faits, Tesla semble pousser trois leviers à la fois : augmenter la flotte, multiplier les tests, et étendre les services qui font rouler les voitures plus souvent. Résultat : les miles parcourus montent, et avec eux la matière première qui nourrit les modèles d’IA. Pour un lecteur intéressé par l’achat, ce mouvement a aussi une conséquence très simple : on se demande quel modèle choisir pour vivre cette technologie au quotidien. Un exemple parlant se trouve dans cette analyse sur la Model 3 en 2026, qui remet en perspective usage, coût et pertinence selon les profils.

Tout cela pose une dernière question, souvent évitée parce qu’elle fâche : comment comparer proprement ces modes de conduite, sans slogans, sans fantasmes ? Un tableau clair aide parfois plus qu’un long discours.

Comparer conduite manuelle et FSD supervisé : un tableau pour garder les pieds sur terre

Parler de conduite assistée sans comparer, c’est comme discuter d’un nouveau smartphone sans parler d’autonomie : on passe à côté de ce que les gens vivent. Les chiffres publiés par Tesla sur la sécurité donnent un angle concret, à condition de les présenter avec méthode.

Le tableau ci-dessous reprend les métriques annoncées sur le dernier cycle de 12 mois pour l’Amérique du Nord, avec la fréquence d’un accident majeur selon le mode de conduite. Il ne dit pas “qui a raison” dans les débats. Il aide à visualiser l’écart, et à poser les bonnes questions sur l’exposition, le type de routes, et les profils de conducteurs.

| Mode de conduite | Fréquence annoncée d’un accident majeur | Lecture pratique |

|---|---|---|

| FSD supervisé activé | 1 accident majeur / 5 300 676 miles | Le système gère, le conducteur surveille et reprend si nécessaire. |

| Conduite manuelle avec sécurité active | 1 accident majeur / 2 175 763 miles | Le conducteur conduit, avec aides type freinage d’urgence et maintien de voie. |

| Conduite manuelle sans sécurité active | 1 accident majeur / 855 132 miles | Moins d’assistance : l’écart illustre l’effet des aides, mais l’exposition exacte compte. |

| Moyenne États-Unis (référence Tesla) | 1 accident majeur / 660 164 miles | Repère global, mélange de véhicules, de routes et de pratiques très hétérogènes. |

Ce tableau ne doit pas servir de prétexte pour dormir au volant. La supervision reste la règle, et la nuance est capitale : un conducteur qui “teste les limites” fausse tout, y compris sa propre sécurité. En revanche, il met en évidence un point intéressant : quand le système est utilisé comme prévu, il peut coïncider avec une baisse des accidents majeurs, du moins selon les données publiées.

Pour rendre ça moins abstrait, prenons un exemple chiffré. “Hugo, 52 ans, cadre à Bordeaux”, fait 30 000 miles par an (gros rouleur, oui). À ce rythme, la différence entre 1 accident majeur tous les 2,17 millions de miles et 1 tous les 5,3 millions ne veut pas dire qu’il “aura” ou “n’aura pas” un accident. Ça signifie simplement que, statistiquement, son exposition au risque pourrait diminuer si le système l’aide réellement sur les segments où il a tendance à relâcher l’attention, typiquement les longues portions monotones.

Et c’est là que ça devient intéressant : si la sécurité progresse, l’acceptation sociale progresse aussi… mais à une condition. Que Tesla, les régulateurs et les utilisateurs parlent la même langue sur ce qu’est le FSD : une assistance avancée, pas un pilote automatique magique. Voilà la passerelle idéale vers la dernière partie : les questions que tout le monde se pose, sans toujours oser les formuler.

FSD supervisé, ça veut dire quoi concrètement ?

Cela signifie que la voiture peut gérer une grande partie de la conduite (trajectoire, vitesse, changements de voie selon les conditions), mais que le conducteur doit surveiller en permanence et reprendre immédiatement si le système se trompe ou hésite. La supervision n’est pas une formalité : c’est une exigence de sécurité.

Les 8 milliards de miles parcourus prouvent-ils que la voiture autonome est prête ?

Ils montrent une adoption massive et une collecte de données en conditions réelles, ce qui aide l’apprentissage. En revanche, un grand volume de miles ne suffit pas à lui seul : ce qui compte aussi, c’est la variété des situations, la gestion des cas rares et la capacité à fonctionner sans conducteur attentif, ce qui n’est pas l’usage du FSD supervisé.

Pourquoi Tesla parle-t-elle autant des 10 milliards de miles ?

Parce que ce seuil est présenté comme un ordre de grandeur pour exposer le système à suffisamment de scénarios réels, y compris ceux qui arrivent rarement. L’idée est d’entraîner des modèles capables de mieux gérer la “longue traîne” des situations imprévisibles que les simulations reproduisent mal.

Les données de sécurité publiées par Tesla suffisent-elles pour comparer avec d’autres marques ?

Elles donnent des repères, mais une comparaison complète demanderait des définitions identiques (ce qu’est un accident “majeur”), des expositions comparables (types de routes, météo, densité urbaine), et des audits indépendants. Elles restent utiles pour comprendre l’ordre de grandeur et suivre l’évolution dans le temps.

Quel usage est le plus cohérent du FSD supervisé au quotidien ?

L’usage le plus cohérent ressemble souvent à ceci : activer l’assistance sur les portions régulières (autoroute, voies rapides bien marquées), rester vigilant, et reprendre la main dès que l’environnement devient complexe (travaux, centre-ville dense, comportements agressifs autour). Beaucoup de conducteurs l’emploient comme une réduction de charge mentale, pas comme un remplacement du conducteur.