Comment l’intelligence artificielle de Google transforme la génération des méta descriptions

Le paysage du référencement connaît une mutation profonde avec l’intégration croissante de l’IA Google dans la génération des extraits de recherche. Jusqu’à récemment, le moteur de recherche se contentait d’ignorer ponctuellement les méta descriptions rédigées par les éditeurs pour extraire directement des passages du contenu jugés plus pertinents selon la requête tapée. Désormais, le processus dépasse la simple extraction : Google reformule, synthétise et compose des descriptions à la manière d’un modèle de langage sophistiqué.

Cette évolution technique marque un tournant stratégique dans l’approche du SEO. Le moteur ne se limite plus à afficher passivement les informations fournies, il les interprète et les reconstruit selon sa propre compréhension du contenu et des intentions de recherche. Un petit logo en forme d’étoile accompagne désormais ces extraits générés automatiquement, signalant clairement l’intervention de l’intelligence artificielle dans leur création.

La machine peut puiser dans plusieurs sources au sein d’une même page : balises HTML, paragraphes de corps de texte, listes à puces, tableaux structurés. Elle assemble ensuite ces fragments pour produire ce qu’elle considère comme un résumé « intelligent », adapté au contexte spécifique de chaque requête. Dans certains cas, un texte généré par l’IA apparaît même en complément de la méta description classique, créant ainsi une double couche d’information.

Cette transformation reflète une tendance de fond dans l’évolution des moteurs de recherche. Plutôt que d’être de simples catalogues organisés, ils deviennent des interprètes actifs du savoir numérique. Pour les professionnels du marketing digital, cette nouvelle donne impose de repenser entièrement la manière dont les contenus sont conçus et structurés. Les observations réalisées sur différentes plateformes, notamment Reddit, révèlent une variété de cas de figure où l’algorithme Google adapte son comportement selon la nature du contenu et le type de requête.

Les mécanismes de sélection et de reformulation automatique du contenu

L’IA Google ne fonctionne pas selon une logique binaire simple. Elle évalue en permanence la pertinence relative de chaque élément textuel présent sur une page. Lorsqu’elle décide de générer sa propre description plutôt que d’utiliser celle fournie, elle applique des critères complexes liés à la cohérence sémantique, à la densité informationnelle et à l’alignement avec l’intention présumée derrière la recherche.

Cette capacité d’analyse permet à Google d’adapter dynamiquement les extraits affichés. Une même page peut ainsi voir sa description varier substantiellement selon que l’internaute cherche des informations générales, des détails techniques ou des avis utilisateurs. L’intelligence artificielle détecte ces nuances et ajuste sa présentation en conséquence, optimisant théoriquement les chances que l’utilisateur trouve précisément ce qu’il recherche.

Les implications pour la stratégie SEO sont considérables. Il ne suffit plus de rédiger une méta description unique et bien tournée : il faut penser l’ensemble du contenu comme une ressource dans laquelle l’IA pourra puiser intelligemment. Cette approche exige une structuration méticuleuse, où chaque paragraphe, chaque liste et chaque titre constitue potentiellement un élément de la description finale que verra l’internaute.

| Type de contenu source | Fréquence d’utilisation par l’IA | Impact sur le CTR |

|---|---|---|

| Méta description originale | 40-60% | Moyen à élevé |

| Premier paragraphe du contenu | 25-35% | Variable |

| Listes et points clés | 15-20% | Élevé |

| Fusion de plusieurs éléments | 10-15% | Très élevé |

L’enjeu du taux de clic et l’influence des données comportementales

Les fuites d’informations concernant le fonctionnement interne de Google ont révélé des détails cruciaux sur le rôle des interactions utilisateurs dans le classement des résultats. Le système Navboost, notamment, exploite les données collectées via Google Chrome pour mesurer les clics réels sur les pages de résultats. Cette surveillance comportementale fournit au moteur une compréhension fine de ce qui suscite réellement l’engagement des internautes.

Lorsqu’un extrait affiche un taux de clic supérieur aux prédictions initiales de l’algorithme, cela envoie un signal positif qui peut favoriser l’amélioration du positionnement. Cette boucle de rétroaction continue signifie que Google teste constamment différentes formulations de descriptions pour identifier celles qui génèrent le meilleur engagement. Le moteur devient ainsi un optimiseur permanent de sa propre interface.

Pour les marques et les créateurs de contenu, cette dynamique change fondamentalement la nature du défi SEO. L’objectif n’est plus uniquement de rédiger « la meilleure méta description » selon des critères fixes, mais de produire un ensemble de contenus riches et structurés que l’algorithme aura naturellement envie de citer. Cette approche nécessite une compréhension approfondie des mécanismes de sélection automatique et une capacité à anticiper les préférences de l’IA.

- Analyse continue des performances des extraits via la Search Console

- Identification des patterns de reformulation propres à chaque type de page

- Ajustement itératif du contenu selon les signaux de clics reçus

- Veille sur les évolutions de l’algorithme Google et ses préférences de citation

- Tests comparatifs entre différentes structures de contenu

La technique du chunking pour structurer les contenus destinés à l’IA

Le « chunking », ou morcellement en français, constitue une approche structurelle fondamentale pour faciliter l’analyse automatique des contenus par les modèles de langage. Cette méthode consiste à diviser l’information en blocs distincts, cohérents et digestes, permettant à l’IA Google d’identifier clairement les unités sémantiques pertinentes à extraire et à reformuler.

Concrètement, le chunking appliqué au référencement implique de concevoir chaque paragraphe comme une unité autonome de sens. Chaque bloc textuel doit idéalement contenir une phrase pivot qui résume l’idée principale, suivie de développements ou d’exemples qui l’étayent. Cette organisation facilite non seulement la lecture humaine, mais surtout l’identification par l’intelligence artificielle des informations clés à potentiellement inclure dans une description générée.

Les titres jouent également un rôle crucial dans cette architecture de l’information. Ils servent de marqueurs cognitifs pour l’IA, lui permettant de catégoriser rapidement les différents segments de contenu. Un titre de sous-section bien formulé indique explicitement le thème traité, rendant le travail d’analyse sémantique plus efficace et réduisant les risques de mauvaise interprétation.

La longueur des paragraphes représente un autre paramètre déterminant. Des blocs trop longs noient l’information principale dans un océan de détails, compliquant la tâche de sélection de l’algorithme. À l’inverse, des paragraphes trop courts peuvent manquer de contexte suffisant pour être compréhensibles isolément. L’équilibre optimal se situe généralement entre 50 et 100 mots par bloc, offrant suffisamment de substance sans diluer le message central.

Principes de découpage et hiérarchisation de l’information

La hiérarchisation logique du contenu facilite considérablement le travail d’interprétation des systèmes automatisés. Une page bien structurée présente d’abord les informations essentielles, puis développe progressivement les détails et les nuances. Cette organisation pyramidale permet à l’IA de saisir rapidement l’essentiel, même si elle ne parcourt qu’une fraction du contenu.

Les listes à puces et numérotées constituent des outils particulièrement efficaces dans cette perspective. Elles encapsulent naturellement l’information en unités distinctes, facilitant l’extraction sélective. Une liste bien conçue peut être citée partiellement ou intégralement dans une description générée, selon la pertinence perçue par l’algorithme par rapport à la requête spécifique. Pour approfondir vos connaissances sur les coulisses techniques de Google, consultez ce guide détaillé sur les projets Google.

| Élément structurel | Fonction pour l’IA | Recommandation d’usage |

|---|---|---|

| Titre H2/H3 | Marqueur thématique principal | Précis, informatif, mots-clés naturels |

| Premier paragraphe de section | Résumé contextuel | Phrase pivot claire, 40-60 mots |

| Listes structurées | Points clés extractibles | 3-7 items, formulations concises |

| Paragraphes de développement | Enrichissement contextuel | 2-4 phrases, cohérence interne |

L’importance des phrases pivots et des transitions logiques

Chaque bloc de contenu devrait idéalement débuter par une phrase qui en synthétise le propos principal. Cette phrase pivot fonctionne comme un micro-résumé que l’IA peut facilement identifier et extraire. Elle articule l’idée centrale de manière autonome, sans dépendre excessivement du contexte environnant pour être comprise.

Les transitions entre paragraphes et sections méritent également une attention particulière. Elles ne doivent pas seulement assurer la fluidité de lecture pour l’humain, mais aussi signaler à l’intelligence artificielle les relations logiques entre les différents blocs d’information. Des connecteurs explicites comme « par conséquent », « en revanche » ou « de cette analyse découle » aident l’algorithme à comprendre la structure argumentative du texte.

Cette approche structurelle ne sacrifie nullement la qualité rédactionnelle au profit de l’optimisation technique. Au contraire, un contenu bien « chunké » améliore simultanément l’expérience de lecture humaine et la compréhension automatique. Les deux objectifs convergent naturellement lorsque la clarté et la logique organisationnelle deviennent prioritaires.

- Débuter chaque section par une phrase résumant son contenu principal

- Maintenir une longueur de paragraphe entre 50 et 100 mots

- Utiliser des listes pour encapsuler les informations multiples

- Insérer des sous-titres descriptifs tous les 200-300 mots

- Privilégier les phrases courtes et la syntaxe directe

- Éviter les digressions qui diluent le message central

Exploiter les biais cognitifs pour optimiser l’engagement sur les résultats de recherche

Les travaux de recherche de Google sur le « Messy Middle » offrent un cadre conceptuel précieux pour comprendre le comportement des utilisateurs dans les pages de résultats. Cette zone intermédiaire désigne l’espace mental et temporel entre le déclencheur initial d’une recherche et la décision finale de cliquer sur un résultat. Durant cette phase, les internautes alternent entre exploration de nouvelles options et évaluation comparative des possibilités identifiées.

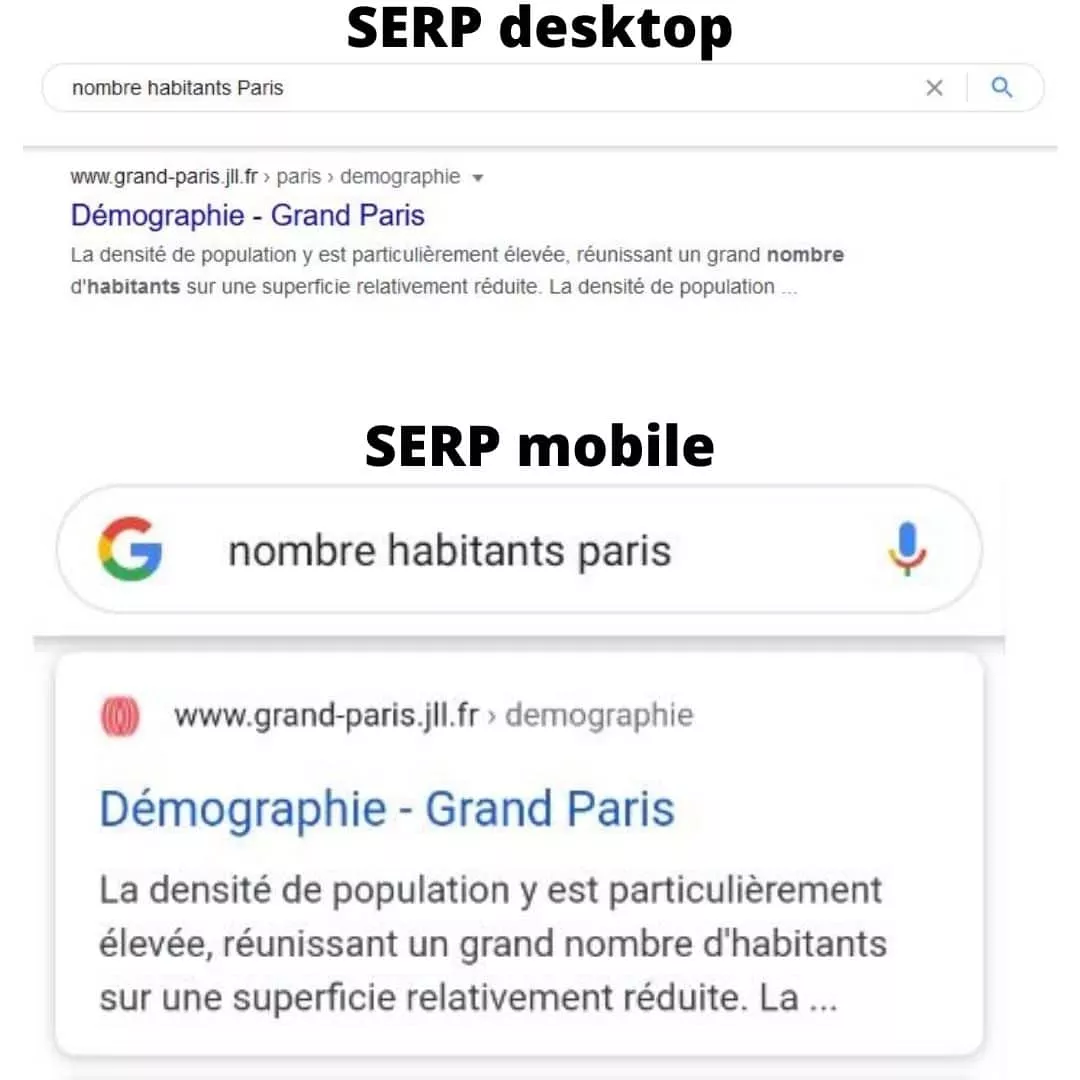

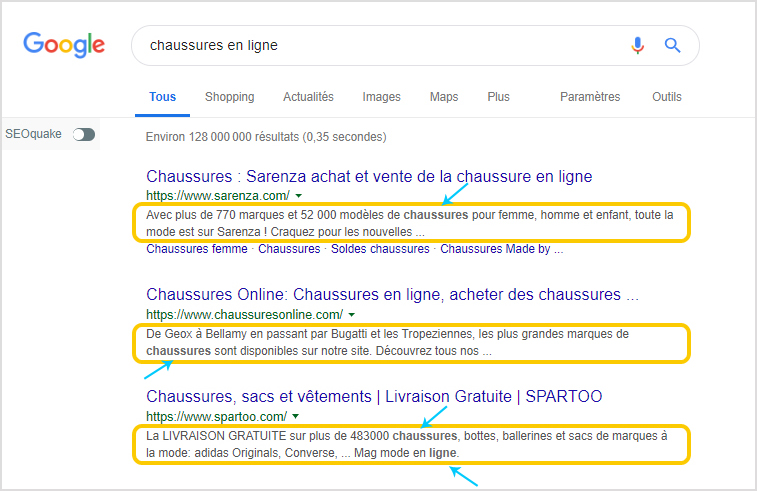

Ce va-et-vient cognitif implique que chaque extrait affiché doit être immédiatement convaincant, captant l’attention au milieu d’une dizaine de concurrents directs. La méta description, qu’elle soit rédigée manuellement ou générée par l’IA, joue donc un rôle déterminant dans cette première impression. Elle doit actionner les leviers psychologiques appropriés pour transformer une simple impression en clic effectif.

Les biais cognitifs documentés par la psychologie comportementale offrent des pistes concrètes d’optimisation. En intégrant stratégiquement ces déclencheurs dans le contenu de la page, on augmente les chances que l’IA Google les reprenne dans la description générée. L’algorithme, entraîné sur des milliards d’interactions, a appris à identifier ces signaux comme des indicateurs de contenu engageant et digne d’être mis en avant.

Heuristiques de catégorisation et éléments différenciants

L’heuristique catégorielle désigne la tendance humaine à simplifier les décisions complexes en se focalisant sur un ou deux attributs distinctifs d’un produit ou service. Face à l’abondance d’options sur une page de résultats, l’internaute cherche instinctivement des marqueurs de différenciation rapides et faciles à évaluer.

Pour une page commerciale visant à capter ce type d’attention, il devient crucial de mettre en avant des caractéristiques uniques ou spécialisées. Des mentions comme « Agence 100% française », « Spécialiste SEO e-commerce » ou « Expert certifié depuis 2010 » fonctionnent comme des marqueurs de catégorie clairs. Lorsque ces éléments sont présents dans le contenu structuré de la page, l’intelligence artificielle peut les identifier comme saillants et les intégrer dans la description affichée.

Cette stratégie nécessite une connaissance précise de son positionnement concurrentiel. Quels attributs distinguent réellement votre offre dans votre secteur ? Quels critères de sélection pèsent le plus lourd dans les décisions de votre audience cible ? Les réponses à ces questions doivent se refléter explicitement dans les premiers paragraphes et les listes récapitulatives de chaque page clé. Pour mieux comprendre comment l’IA transforme différents secteurs, découvrez l’impact de Google sur Hollywood.

| Biais cognitif | Formulation efficace | Contexte d’usage optimal |

|---|---|---|

| Heuristique catégorielle | « Spécialiste exclusif de… » | Pages de services B2B |

| Pouvoir de l’immédiateté | « Résultats en 48h » | Offres à conversion rapide |

| Preuve sociale | « Approuvé par 10 000+ clients » | Pages produits e-commerce |

| Autorité | « Certifié ISO, 15 ans d’expertise » | Services professionnels |

| Rareté | « Places limitées, offre exclusive » | Pages événements/formations |

Le pouvoir de l’immédiateté et les signaux de rapidité

Les recherches en économie comportementale démontrent que les individus valorisent disproportionnellement les gratifications immédiates par rapport aux bénéfices différés, même lorsque ces derniers sont objectivement supérieurs. Transposé au contexte du référencement, ce biais suggère d’accentuer la rapidité d’exécution ou de livraison dans les contenus destinés à être extraits par l’IA.

Des formulations comme « Audit SEO en 48h », « Livraison le jour même » ou « Réponse garantie sous 2h » activent puissamment ce mécanisme psychologique. Elles transforment une promesse abstraite en engagement temporel concret, réduisant l’anxiété de l’attente et augmentant la probabilité de conversion. Lorsque l’IA Google détecte ces marqueurs temporels dans une page, elle tend à les considérer comme des informations à forte valeur pour l’utilisateur.

L’intégration de ces éléments doit néanmoins rester authentique et vérifiable. Des promesses exagérées ou irréalistes risquent non seulement de décevoir l’utilisateur après le clic, mais aussi d’entraîner un taux de rebond élevé qui pénalisera à terme le positionnement. La cohérence entre la description affichée et le contenu réel de la page demeure fondamentale pour maintenir la confiance de l’algorithme et des visiteurs.

- Quantifier précisément les délais de livraison ou de réponse

- Utiliser des formulations temporelles concrètes plutôt que vagues

- Positionner ces informations dans les premiers paragraphes et listes

- Associer la rapidité à des garanties de qualité pour éviter la perception de bâclage

- Renouveler ces mentions dans différentes sections pour maximiser les chances d’extraction

Preuve sociale, rareté et autorité comme amplificateurs de confiance

La preuve sociale repose sur notre tendance à considérer comme valides les choix effectués par un grand nombre de personnes. Des mentions comme « Utilisé par plus de 50 000 entreprises », « Note moyenne de 4,8/5 sur 2 300 avis » ou « Recommandé par 9 clients sur 10 » déclenchent ce mécanisme de validation collective. Ces éléments chiffrés, lorsqu’ils sont présents dans le contenu, constituent des candidats privilégiés pour l’extraction par l’intelligence artificielle.

Le biais de rareté fonctionne selon une logique complémentaire : ce qui est limité ou difficile d’accès acquiert automatiquement plus de valeur perçue. « Places limitées », « Édition exclusive », « Derniers exemplaires disponibles » sont autant de formulations qui activent ce ressort psychologique. En marketing digital, cette technique s’avère particulièrement efficace pour les pages de conversion ou de promotion temporaire.

L’autorité s’appuie sur notre disposition à faire confiance aux experts reconnus. Certifications professionnelles, labels de qualité, années d’expérience, publications académiques ou partenariats prestigieux constituent des marqueurs d’autorité puissants. « Expert certifié Google Partner », « Labellisé par l’organisation X », « 20 ans d’expertise sectorielle » fonctionnent comme des signaux de crédibilité que l’algorithme valorise naturellement. Les avancées technologiques de Google dans ce domaine sont explorées dans cet article sur les progrès de l’IA Google.

La combinaison stratégique de ces différents biais crée un effet synergique. Une page qui intègre simultanément preuve sociale, signaux d’immédiateté et marqueurs d’autorité maximise ses chances de générer des descriptions particulièrement convaincantes. L’IA Google, entraînée à identifier les contenus à fort potentiel d’engagement, privilégiera naturellement l’extraction et la mise en avant de ces éléments.

Le rôle des données structurées dans la compréhension par les modèles de langage

Les microdonnées et le balisage sémantique constituent des couches d’information supplémentaires qui facilitent considérablement l’interprétation automatique des contenus web. Alors que le texte brut nécessite une analyse linguistique complexe pour en extraire le sens, les données structurées offrent une cartographie explicite des informations présentes sur une page.

Les grands modèles de langage utilisés par Google pour générer les descriptions intelligentes bénéficient directement de cette structuration explicite. Lorsqu’une page implémente correctement le balisage Schema.org, elle communique sans ambiguïté la nature de son contenu : s’agit-il d’un article, d’un produit, d’un service, d’un événement, d’une recette ? Cette classification immédiate permet à l’algorithme Google d’adapter son traitement et sa présentation.

Au-delà de la simple catégorisation, les données structurées encodent des attributs spécifiques : prix, disponibilité, note moyenne, auteur, date de publication, durée de préparation, localisation. Ces informations précisément balisées peuvent être extraites et intégrées dans les extraits enrichis affichés sur les pages de résultats, augmentant significativement la visibilité et l’attractivité du résultat.

Types de balisages pertinents pour l’optimisation des descriptions

Le vocabulaire Schema.org propose des centaines de types d’entités et de propriétés. Pour l’optimisation des méta descriptions générées par l’IA, certains schémas se révèlent particulièrement stratégiques. Le type « Article » permet de baliser explicitement le titre, l’auteur, la date de publication et le résumé, guidant l’algorithme vers les éléments les plus pertinents à extraire.

Pour les sites e-commerce, le schéma « Product » devient incontournable. Il structure les informations essentielles que recherchent les acheteurs potentiels : nom du produit, image, prix, disponibilité, évaluations. Lorsque Google génère une description pour une page produit correctement balisée, il peut composer un extrait beaucoup plus informatif et actionnable qu’avec du texte non structuré.

Les services professionnels gagnent à implémenter le schéma « Service », qui décrit précisément la nature de l’offre, la zone géographique couverte, le fournisseur et les modalités. Les pages d’événements profitent du schéma « Event » pour communiquer dates, lieu, organisateur et modalités de participation. Cette explicitation sémantique réduit drastiquement le risque de mauvaise interprétation par l’intelligence artificielle. Pour découvrir d’autres stratégies digitales, consultez ces astuces pour améliorer votre visibilité Instagram.

| Type de schéma | Propriétés clés | Impact sur les descriptions générées |

|---|---|---|

| Article | headline, author, datePublished, description | Extraction précise du titre et du résumé |

| Product | name, price, availability, aggregateRating | Affichage enrichi avec prix et notes |

| Service | serviceType, provider, areaServed | Clarification de l’offre et de la couverture |

| Organization | name, logo, contactPoint, sameAs | Renforcement de l’identité de marque |

| FAQ | Question, Answer | Extraction potentielle dans snippets enrichis |

Implémentation technique et validation des microdonnées

L’implémentation des données structurées peut suivre plusieurs syntaxes : JSON-LD (recommandée par Google), microdata (intégrée dans les balises HTML) ou RDFa. Le format JSON-LD présente l’avantage de la séparation claire entre le code sémantique et le contenu visible, facilitant la maintenance et réduisant les risques d’erreurs.

La validation des microdonnées constitue une étape essentielle souvent négligée. Google propose un outil de test des résultats enrichis qui permet de vérifier que le balisage est correctement interprété par ses systèmes. Des erreurs de syntaxe ou des propriétés manquantes peuvent neutraliser complètement les bénéfices attendus, d’où l’importance d’un contrôle systématique après chaque implémentation.

L’évolution continue du vocabulaire Schema.org impose une veille régulière. De nouveaux types et propriétés apparaissent régulièrement, reflétant l’émergence de nouvelles catégories de contenus ou de besoins d’information. Rester à jour sur ces évolutions permet de bénéficier rapidement des nouvelles possibilités d’enrichissement des extraits de recherche.

- Privilégier le format JSON-LD pour sa facilité de maintenance

- Valider systématiquement le balisage avec les outils officiels de Google

- Implémenter les propriétés optionnelles pertinentes, pas seulement les obligatoires

- Maintenir la cohérence entre les données structurées et le contenu visible

- Mettre à jour le balisage lors de modifications substantielles du contenu

- Surveiller les nouvelles extensions du vocabulaire Schema.org

Mesurer et ajuster l’efficacité des méta descriptions à l’ère de l’IA

L’évaluation précise de l’impact d’une méta description sur les performances SEO représente un défi méthodologique considérable. Contrairement aux campagnes publicitaires payantes où les tests A/B contrôlés sont possibles, le référencement naturel ne permet pas d’isoler facilement l’effet d’une seule variable. Les fluctuations de positionnement, les variations saisonnières de recherche et l’évolution constante de l’algorithme Google créent un environnement analytique complexe.

La Google Search Console fournit néanmoins des données précieuses pour observer les tendances. Elle segmente les performances par requête, par appareil, par pays et par position moyenne. Cette granularité permet d’identifier les pages où les modifications de description semblent avoir eu un impact positif ou négatif sur le taux de clic. L’analyse comparative avant/après, à position et requête équivalentes, offre les signaux les plus fiables.

La détection des pages où Google réécrit fréquemment la description constitue un indicateur diagnostic important. Ces réécritures systématiques signalent généralement que le contenu proposé ne satisfait pas l’algorithme, soit par manque de pertinence, soit par structuration inadéquate. Identifier ces pages permet de prioriser les efforts d’optimisation là où le potentiel d’amélioration est maximal.

Indicateurs clés de performance et méthodologie d’analyse

Le taux de clic (CTR) représente évidemment la métrique centrale pour évaluer l’efficacité d’une description. Toutefois, ce chiffre brut ne prend sens que replacé dans son contexte : position moyenne, type de requête, intention de recherche. Un CTR de 3% peut être excellent en position 5 sur une requête informationnelle, mais médiocre en position 1 sur une requête transactionnelle à forte intention d’achat.

Les outils d’analyse SEO proposent généralement des courbes de CTR attendu par position, basées sur l’agrégation de millions de données. Comparer le CTR observé sur une page donnée avec le CTR théorique pour sa position moyenne permet d’identifier les sur-performances et les sous-performances. Une page qui dépasse systématiquement le CTR attendu indique probablement une description particulièrement attractive ou bien optimisée. Pour explorer d’autres outils d’optimisation, découvrez Google NotebookLM comme coach de révision.

L’analyse des requêtes spécifiques générant le plus d’impressions mais peu de clics révèle des opportunités d’amélioration ciblées. Ces requêtes signalent que la page apparaît dans les résultats mais échoue à convaincre l’internaute. Reformuler le contenu pour mieux répondre à ces intentions spécifiques peut débloquer un trafic latent significatif.

| Position moyenne | CTR attendu standard | CTR optimisé possible | Facteurs d’amélioration |

|---|---|---|---|

| 1 | 25-35% | 40-50% | Description percutante, éléments enrichis |

| 2-3 | 10-15% | 18-25% | Différenciation claire vs concurrents |

| 4-6 | 4-7% | 8-12% | Signaux de confiance, spécificité |

| 7-10 | 2-3% | 4-6% | Appels à l’action, urgence |

Stratégies d’ajustement itératif et cycles d’optimisation

L’optimisation des méta descriptions à l’ère de l’IA nécessite une approche itérative plutôt qu’une intervention ponctuelle. Les variations des comportements de recherche, les ajustements algorithmiques constants et l’évolution de la concurrence imposent un suivi régulier et des ajustements progressifs.

Une méthodologie efficace consiste à établir des cycles d’optimisation trimestriels. Durant chaque cycle, identifier 10 à 20 pages prioritaires présentant un écart significatif entre CTR observé et CTR attendu. Analyser en détail comment Google réécrit ou utilise les descriptions de ces pages. Reformuler ensuite le contenu en appliquant les principes de chunking, de biais cognitifs et de données structurées évoqués précédemment.

Le monitoring post-modification doit s’étaler sur au moins 4 à 6 semaines pour capturer des données statistiquement significatives. Les fluctuations de court terme peuvent être trompeuses, dues à des variations aléatoires ou à des événements ponctuels. Seule l’observation d’une tendance confirmée sur plusieurs semaines permet de valider l’efficacité d’une optimisation. Pour mieux comprendre l’évolution de la recherche Google, consultez cet article sur l’avenir de la recherche Google avec l’IA.

La documentation méticuleuse des modifications effectuées et de leurs résultats constitue un actif précieux sur le long terme. Elle permet de construire progressivement une compréhension empirique de ce qui fonctionne spécifiquement pour votre site, votre audience et votre secteur. Cette connaissance propriétaire devient un avantage concurrentiel durable dans la stratégie SEO.

- Établir des cycles d’optimisation réguliers (trimestriels recommandés)

- Prioriser les pages à fort potentiel de trafic avec CTR sous-optimal

- Documenter toutes les modifications et leurs justifications

- Attendre 4-6 semaines avant d’évaluer l’impact d’un changement

- Comparer les performances avec les courbes de CTR théoriques

- Identifier les patterns de reformulation par l’IA sur vos pages

- Ajuster progressivement en fonction des signaux observés

Limitations méthodologiques et approche pragmatique

La complexité inhérente au référencement impose une certaine humilité analytique. Isoler l’effet exact d’une modification de méta description reste fondamentalement difficile dans un écosystème où des centaines de facteurs interagissent simultanément. Les tests A/B rigoureux demeurent quasi impossibles en SEO organique, contrairement aux campagnes payantes où les conditions expérimentales peuvent être contrôlées.

Cette limitation ne justifie pas l’inaction, mais appelle plutôt à une approche pragmatique fondée sur les tendances observables et les meilleures pratiques validées empiriquement par la communauté SEO. Les signaux directionnels, même imparfaits, permettent d’orienter progressivement la stratégie dans la bonne direction.

L’acceptation de l’incertitude fait partie intégrante du métier de référenceur dans l’environnement actuel. L’IA Google introduit une couche supplémentaire d’imprévisibilité, ses décisions de reformulation variant selon des logiques qui ne sont pas toujours transparentes ou cohérentes. Cette opacité relative ne doit pas paralyser l’action, mais encourager l’expérimentation méthodique et la capitalisation progressive des apprentissages.

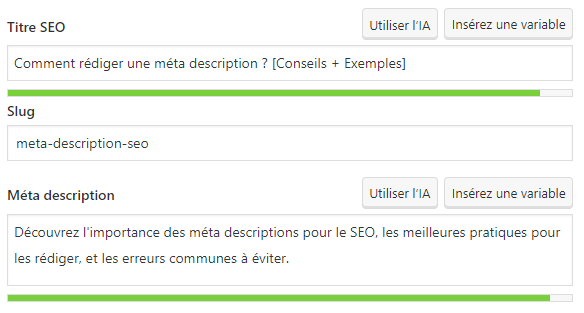

Comment savoir si Google réécrit ma méta description ?

La Google Search Console permet d’observer les impressions générées et le CTR de chaque page. Si vous constatez que l’extrait affiché dans les résultats de recherche diffère systématiquement de votre méta description rédigée, cela indique que Google la reformule. Un petit logo en forme d’étoile peut également apparaître pour signaler une génération par l’IA. Comparez régulièrement les extraits affichés avec votre texte original pour identifier les pages concernées.

La longueur idéale d’une méta description a-t-elle changé avec l’IA de Google ?

La limite technique reste approximativement de 155-160 caractères pour l’affichage complet sur ordinateur et environ 120 caractères sur mobile. Cependant, avec la génération automatique, cette contrainte devient moins rigide puisque Google peut reformuler le texte selon ses propres critères. Il reste néanmoins recommandé de rédiger une méta description concise et percutante dans cette fourchette, tout en structurant l’ensemble du contenu de la page pour faciliter l’extraction par l’IA.

Les données structurées améliorent-elles vraiment le CTR des pages ?

Les études de cas montrent que l’implémentation correcte de données structurées augmente généralement le CTR de 10 à 30% selon les secteurs, principalement grâce aux extraits enrichis affichés dans les résultats. Les étoiles d’évaluation, les prix, les dates d’événements ou les temps de préparation de recettes rendent le résultat plus visuel et informatif, augmentant significativement son attractivité par rapport aux extraits textuels standards.

Faut-il encore écrire des méta descriptions si Google les réécrit ?

Absolument. Même lorsque Google reformule, il utilise souvent la méta description comme base ou source principale d’information. Une description bien rédigée guide l’algorithme et augmente les chances que le message essentiel soit préservé. De plus, en structurant correctement l’ensemble du contenu de la page selon les principes du chunking, vous offrez à l’IA un matériau de qualité pour composer des extraits pertinents qui reflètent fidèlement votre positionnement.

Combien de temps faut-il pour voir l’impact d’une optimisation de méta description ?

Les effets d’une modification de méta description ou de structure de contenu prennent généralement 4 à 6 semaines avant d’être statistiquement observables. Ce délai s’explique par le temps nécessaire pour que Google recrawle la page, mette à jour son index, et accumule suffisamment de données d’interaction utilisateur. Les variations de court terme, observables en quelques jours, relèvent souvent de fluctuations normales et ne constituent pas un signal fiable de l’efficacité d’une optimisation.